GPT Image 2 para Storyboarding de Vídeos com IA em 2026

Oi, gente! Mariana aqui. Comecei esse teste do jeito errado.

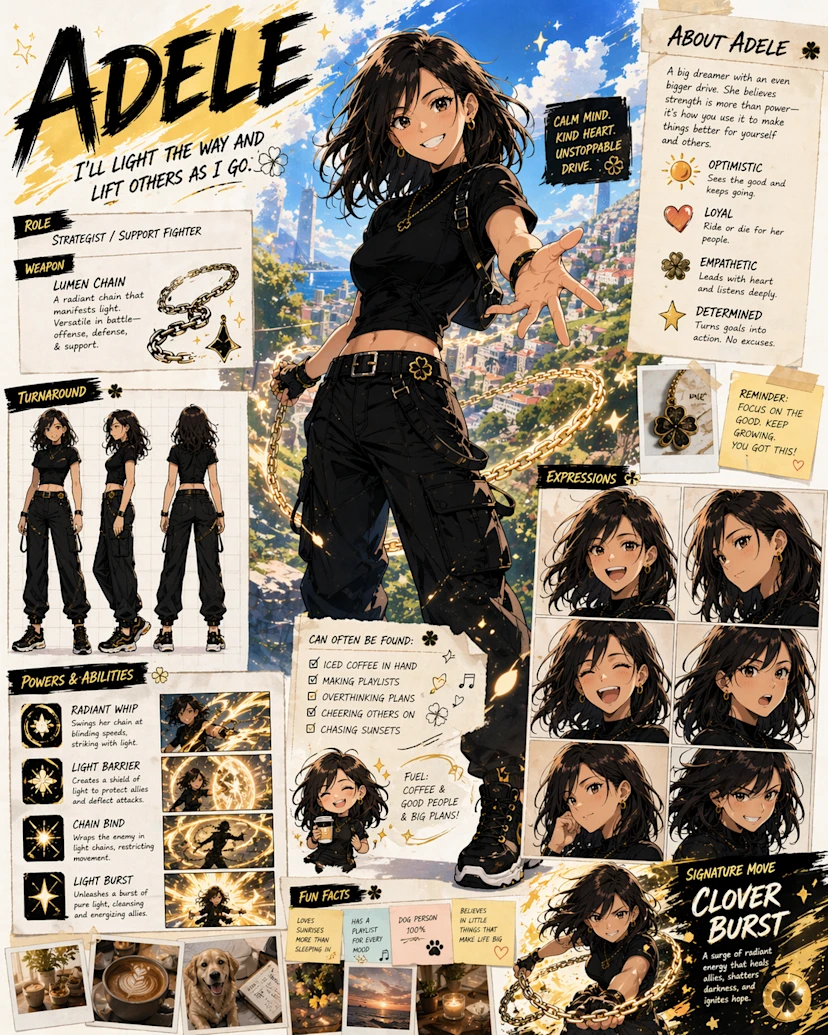

Na minha primeira sessão com o recurso de múltiplas imagens do GPT Image 2, gerei oito frames do mesmo personagem em cenas diferentes. Ficou limpo. Parecia uma virada de jogo. Aí eu dei zoom no frame quatro e a jaqueta do personagem tinha mudado de cor. No frame sete, a estrutura óssea em volta do queixo estava sutilmente diferente. Nada óbvio à primeira vista — mas no segundo em que você corta entre esses frames na edição, seu olho pega na hora.

Essa é a realidade de usar o gpt-image-2 pra storyboarding em 2026. Melhorou muito, mas não é perfeito. Esse artigo cobre onde funciona, onde quebra, e como contornar esses limites.

Por que storyboarding com IA era difícil antes

Drift de personagem entre cenas

O problema central da geração de imagens com IA sempre foi o drift. Gera o mesmo personagem duas vezes — mesmo prompt, mesmo estilo — e você recebe duas pessoas diferentes. Mesma vibe, rosto diferente, proporções diferentes, às vezes até o cabelo muda.

Não é problema de prompt. É estrutural. Modelos de difusão não lembram o que acabaram de criar — cada imagem é uma geração nova do zero. Tudo bem pra imagens únicas, mas pro storyboarding, quebra a continuidade direto.

Existiam gambiarras: seed-locking, ControlNet, ou encadeamento de imagens de referência. Funcionavam, mas eram pesadas — a consistência virava um workflow em si.

Problemas de continuidade de cena

A consistência de personagem era só metade do problema. As cenas também não se sustentavam. Iluminação, fundos, objetos e tons de cor mudavam entre gerações — mesmo com prompts idênticos.

Na edição, isso aparece na hora. Os cortes ficam estranhos, os ambientes não batem, e os props mudam entre os frames — forçando uma regeneração ou correções manuais que jogam fora todo o tempo economizado.

O que a geração multi-imagem do GPT Image 2 muda

Mesmo prompt, múltiplos enquadramentos e ângulos

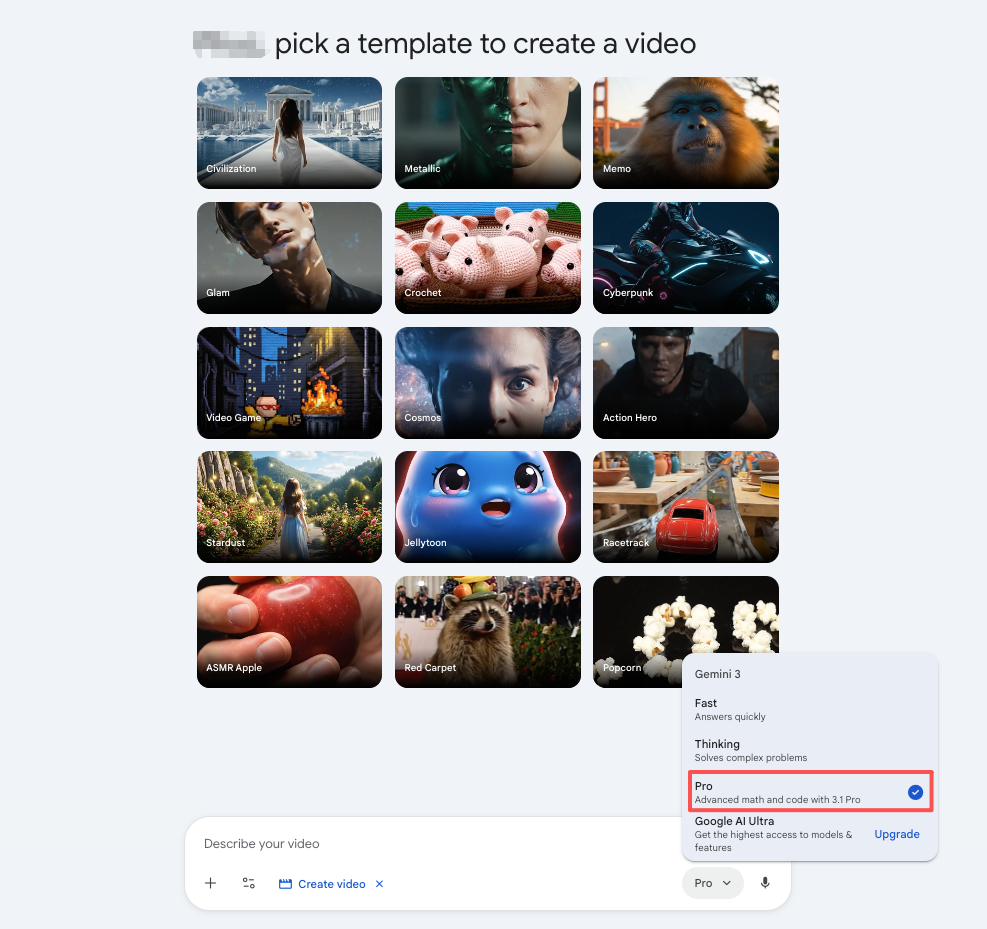

O GPT Image 2 foi lançado em 21 de abril de 2026, trazendo o modo Thinking — disponível nos planos pagos — que permite até oito imagens consistentes a partir de um único prompt. Usuários do plano gratuito ficam limitados ao modo Instant, que não suporta raciocínio multi-imagem.

A diferença principal é o raciocínio integrado. Antes de gerar, o modelo planeja a composição, verifica o posicionamento dos objetos e mantém a consistência espacial — o que dá uma vantagem clara sobre workflows tradicionais de difusão.

Se você está buildando em produção, trave no snapshot de API

gpt-image-2-2026-04-21O que isso muda pra narrativas curtas de 3 a 5 frames

Pra quem cria short-form, isso é uma atualização real. O que antes exigia workflows de referência ou seed-locking agora dá pra fazer em uma única rodada.

Um prompt estruturado com personagem claro e lista de frames pode gerar um storyboard utilizável de 3 a 5 cenas em uma só execução.

Não é perfeito — mas bom o suficiente pra você refinar, não reconstruir do zero.

Workflow — do roteiro ao storyboard até o curta animado

Sendo direta: esse workflow exige prática pra ter resultados consistentes. Nas primeiras duas ou três vezes, você vai regenerar mais do que quer. Na quinta sessão, você já tem uma estrutura de prompt que funciona pro seu tipo de personagem e estilo.

Passo 1: divida seu roteiro em 3 a 6 beats

Antes de abrir o GPT Image 2, converta seu roteiro em beats visuais. Não cenas — beats. Um beat é um único momento visual: estabelecer localização, reação do personagem, ação, revelação, punchline. Se seu skit tem dez beats, corte pra seis. Cada frame do storyboard deve carregar peso, não preencher tempo.

Escreva esses beats como descrições visuais de uma frase antes de abrir a ferramenta de imagem. "Personagem olha pra câmera, expressão cética, fundo de cozinha" bate "personagem em cena de cozinha" toda vez.

Passo 2: gere referências de personagem e cenário

Antes de gerar, monte um pequeno conjunto de referências:

Uma imagem do personagem (vista frontal, expressão neutra, iluminação clara)

Uma imagem do ambiente principal

Esses se tornam suas âncoras de consistência, especialmente pra workflows de animação I2V mais pra frente. Pular esse passo é onde a maioria dos problemas de inconsistência começa.

Passo 3: gere os frames por cena com consistência de referência

Não escreva uma descrição de cena — escreva uma lista de frames. Inclua:

Descrição clara do personagem (traços específicos importam)

Direções de câmera frame a frame (aberto → médio → close)

Descrição travada do ambiente (mesmo fundo em todos os frames)

Uma diretiva de estilo consistente (não repita por frame)

Mais detalhe = mais consistência. Isso é especialmente importante pra estilos fotorrealistas; estilos de ilustração são mais tolerantes.

Passo 4: revise e regenere os frames fracos

Você não vai acertar todos os frames na primeira geração. Resultado padrão nos meus testes: 3 a 4 frames sólidos, 1 a 2 precisam de retentativa. Não regenere o conjunto inteiro. Isole os frames fracos, faça upload da sua imagem de referência e gere só esses frames com a referência anexada.

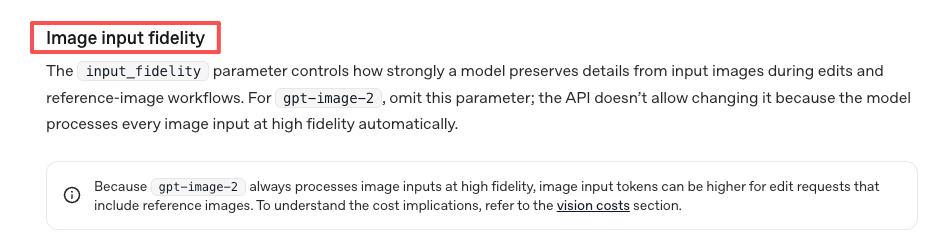

De acordo com o guia oficial de geração de imagens da OpenAI, o modelo suporta inputs de imagem em alta fidelidade — ou seja, imagens de referência enviadas são processadas em resolução completa em vez de reduzidas. Isso importa pra consistência de rosto do personagem quando você está fazendo regeneração pontual de frames fracos.

Planeje uma taxa de regeneração de 20 a 30% nos seus primeiros projetos. Esse número cai conforme seus templates de prompt amadurecem.

Passo 5: passe cada frame pra um modelo I2V

Depois que seus frames de storyboard estiverem aprovados, alimente cada um em um modelo de imagem-para-vídeo (I2V) como referência.

Duas opções comuns:

Kling 3.0 — melhor pra animação multi-cena com custo-benefício. Seu modo storyboard suporta 3 a 12 cenas com personagens consistentes, iluminação e controle de câmera. (~$0,10/seg)

Veo 3.1 — melhor se você precisa de áudio sincronizado nativo. Suporta múltiplas imagens de referência e mantém consistência entre cenas.

Escolha um modelo e fique nele. Misturar ferramentas no meio do projeto geralmente causa drift de estilo visível.

Passo 6: monte e ajuste o ritmo pro short-form

Importe seus clipes no seu setup de edição. Para conteúdo de skit em série, clipes de 3 a 5 segundos por beat acertam o ritmo certo pro TikTok e Reels. Conteúdo narrativo sem rosto geralmente funciona melhor com 4 a 7 segundos por beat.

Corte na ação do personagem, não no silêncio. Se o clipe de IA começa com um frame parado antes do movimento começar — corte. Essa pausa é o maior sinal de que um clipe é gerado por IA.

O que o GPT Image 2 ainda não garante

Correspondência perfeita de rosto em 10+ frames

O limite de 8 frames e a qualidade de consistência dentro desses oito frames não são a mesma coisa. Na prática, a consistência se sustenta bem em 3 a 5 frames no modo Thinking. A partir dos frames 6 a 8, um drift sutil se acumula: o espaçamento dos olhos muda levemente, o formato do queixo suaviza, o tom de pele aquece ou esfria. A própria documentação oficial reconhece que cenas complexas com múltiplos personagens ainda são uma limitação conhecida do modelo.

Pra uma sequência de 10+ frames, você não vai ter consistência em um único prompt. Você está gerenciando múltiplas sessões de geração com imagens de referência entre elas, e depois fazendo revisão de continuidade no pós. Isso está mais perto de um pipeline de produção tradicional do que "IA faz tudo".

Continuidade fina de figurino e props

O rosto do personagem vai ser mais consistente do que os acessórios. Brincos desaparecem. Fivelas de cinto mudam de formato. Props na mão mudam de posição ou design entre frames.

Solução: projete seu personagem sem acessórios pequenos se você está dependendo puramente de consistência por prompt. Ou trate props como elemento editorial — introduza-os só nos frames onde importam, não como detalhes de fundo em todas as cenas.

Táticas híbridas quando a consistência quebra

Upload de imagens de referência

A forma mais confiável de manter consistência é usar imagens de referência. Quando um frame deriva, anexe sua imagem aprovada ao novo prompt — o input visual ancora o modelo de forma muito mais forte do que texto sozinho.

Antes de começar um projeto, monte uma pequena biblioteca de imagens de referência aprovadas por personagem e cena. Trate isso como setup essencial, não como correção pós-problema.

Usando modelos I2V com referência de personagem

Alguns modelos I2V carregam a consistência além do que o GPT Image 2 consegue sozinho no nível de storyboard. O recurso Elements do Kling 3.0 mantém consistência de personagem fazendo upload de imagens de referência que persistem entre gerações — o que significa que drift que escapou na fase de storyboard pode ser parcialmente corrigido na fase de animação.

Pense nisso como um sistema de consistência em dois estágios: GPT Image 2 te leva 80 a 90% do caminho no nível de storyboard, e o recurso de referência do seu modelo I2V fecha a lacuna restante na animação.

Receitas por caso de uso

Canal de skit diário: roteiro de 4 beats, um personagem recorrente, um cenário recorrente. Um prompt de 4 frames no modo Thinking por episódio, uma imagem de referência de personagem salva reutilizada em todos os episódios. Kling pra clipes de movimento de 3 a 4 segundos por frame. Depois que seu template de prompt estiver travado, o tempo de produção por episódio fica em 4 a 6 minutos. O primeiro episódio leva mais tempo.

Canal narrativo sem rosto: roteiro com voz em off, 5 a 8 beats visuais, personagem estilizado com design de ilustração flat. A consistência se mantém significativamente melhor com ilustração do que com fotorrealismo — não é uma gambiarra, é uma escolha de design deliberada que remove um dos problemas de consistência mais difíceis do workflow. Qualquer modelo I2V com image-to-video funciona; movimento sutil combina melhor com conteúdo narrativo do que movimento dramático.

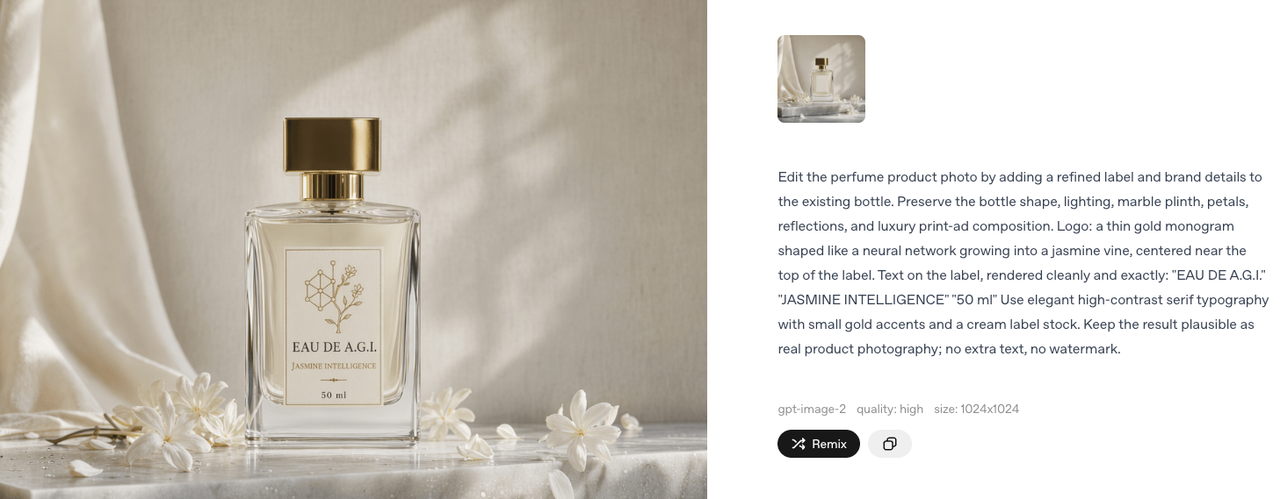

Variante de anúncio multi-cena: produto mais personagem, estrutura de anúncio de 3 a 4 frames (gancho, revelação do produto, reação, frame de CTA). Gere sua sequência central de 4 frames uma vez. Produza 3 a 4 variantes trocando só o frame de gancho — mantém o custo de produção baixo enquanto te dá dados reais de teste criativo em diferentes momentos de abertura.

FAQ

Quantos frames antes da consistência quebrar?

4 a 5 é o intervalo confiável em uma única geração no modo Thinking. Depois disso, você está gerenciando drift em vez de prevenindo. Para 6+ frames, quebre em múltiplas sessões com imagens de referência ancorando cada novo lote.

Melhor modelo I2V pra persistência de personagem?

Kling 3.0 pra consistência multi-cena com bom custo-benefício (~$0,10/segundo). Veo 3.1 se você precisa de áudio sincronizado nativo no mesmo passo. Ambos suportam input de imagem de referência — esse recurso é inegociável pra workflows de storyboard baseados em personagem.

O GPT Image 2 substitui um workflow de Midjourney + referência?

Pra sequências de 3 a 5 frames: na maior parte, sim, com bem menos overhead. Pra sequências de 10+ frames: não. O workflow de encadeamento de imagens de referência do Midjourney ou Flux + ControlNet ainda te dá controle mais preciso sobre consistência multi-frame em escala. São ferramentas diferentes com tetos diferentes.

O uso de storyboard é coberto pela licença comercial?

Você é dono do output que cria — imagens geradas pra storyboarding podem ser usadas comercialmente. Mas você é responsável por evitar personagens com copyright ou problemas de semelhança com pessoas reais. Confira os detalhes completos no guia oficial de geração de imagens da OpenAI.

Conclusão

O GPT Image 2 é uma melhoria real pra storyboarding short-form. A capacidade de gerar sequências multi-frame coerentes a partir de um único prompt — com continuidade de personagem e objeto mantida entre as cenas — ataca diretamente o problema mais difícil na produção de conteúdo sequencial assistida por IA. Isso é novo. Importa.

Mas "problema difícil, agora mais fácil" não é o mesmo que "resolvido". Você ainda precisa gerenciar imagens de referência. Ainda precisa planejar pra regeneração. Ainda precisa de um modelo I2V pra carregar a consistência do frame pra animação. Os criadores que vão aproveitar mais esse workflow são os que constroem a infraestrutura primeiro — pastas de referência, templates de prompt, seleção consistente de modelo I2V — antes de começar o primeiro projeto real.

Ainda estou testando. Minha taxa de re-edição em frames de storyboard de IA está em torno de 25% — caiu dos 60% quando eu usava geração encadeada de imagem única. Atualizo quando esse número mudar.

Leituras Recomendadas

Guia de Prompts no GPT Image 2 pra Criadores de Short-Form