Como transformar imagens do GPT Image 2 em vídeos curtos

Oi, sou a Mariana. Três semanas atrás fiz um teste simples: mesmo briefing, quatro modelos de imagem, um cronômetro. O GPT Image 2 — lançado como "ChatGPT Images 2.0" em 21 de abril — me entregou o produto mais limpo. Texto perfeito, composição sólida, exportação 9:16 sem drama.

Me senti ótima com isso por uns doze segundos. Aí lembrei: não tem movimento. Esse é o gargalo real agora. O GPT Image 2 te dá algo que parece pronto, mas é só o primeiro frame. Tudo entre esse frame e um vídeo publicado ainda é por sua conta.

Esse artigo é sobre fechar essa lacuna — transformar os outputs do GPT Image 2 num pipeline repetível que termina com um clipe pronto pro TikTok, Shorts ou Reels.

Vou mostrar o fluxo, quais modelos I2V funcionam melhor, os principais pontos de falha (principalmente o problema do texto distorcido) e três receitas práticas pra usar agora.

Por que combinar o GPT Image 2 com um modelo I2V

O que o GPT Image 2 te entrega — frames consistentes e de alta fidelidade

O GPT Image 2 chega com renderização de texto quase perfeita, fotorrealismo melhorado e o que a OpenAI chama de "capacidades de raciocínio" — ou seja, ele verifica os próprios outputs e consegue gerar variantes em vários formatos a partir de um único prompt. Pra conteúdo short-form especificamente, isso importa muito. Rótulos de produto ficam legíveis. Logos não distorcem. Você pede um recorte 9:16 e realmente recebe um que está composto corretamente, não só cortado mecanicamente.

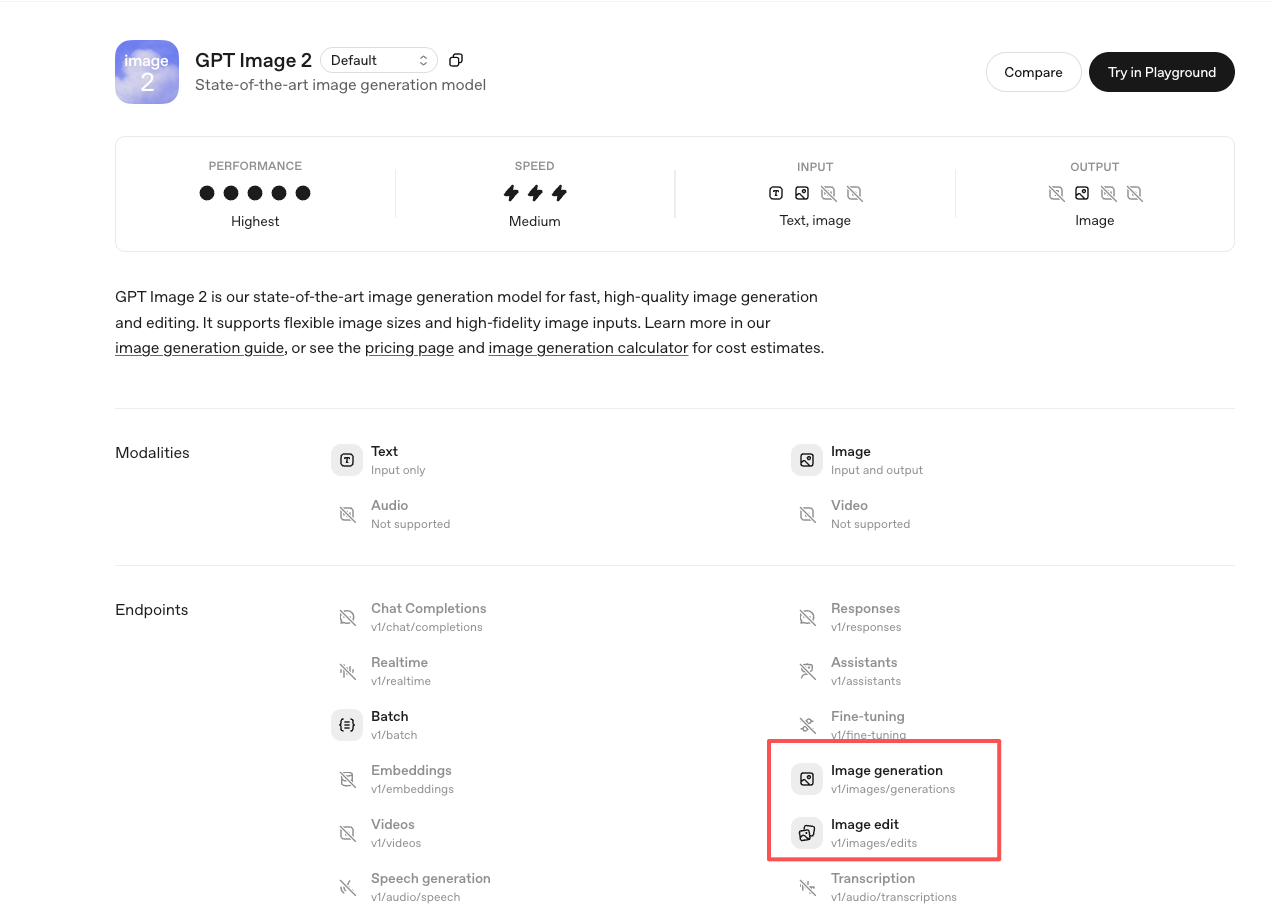

Segundo a documentação da API de geração de imagens da OpenAI, o modelo está disponível em dois endpoints:

gpt-image-2Só que tem uma coisa que ninguém te fala: o GPT Image 2 não te dá movimento, duração nem ritmo. Ele te dá um frame. Um frame incrível — mas estático.

O que ainda falta — movimento, duração e ritmo

Os modelos I2V analisam profundidade, intenção do sujeito e iluminação, depois extrapolam de 5 a 15 segundos de animação crível. Você controla o frame principal. O modelo cuida de tudo depois dos primeiros 0,04 segundos.

Pré-requisitos

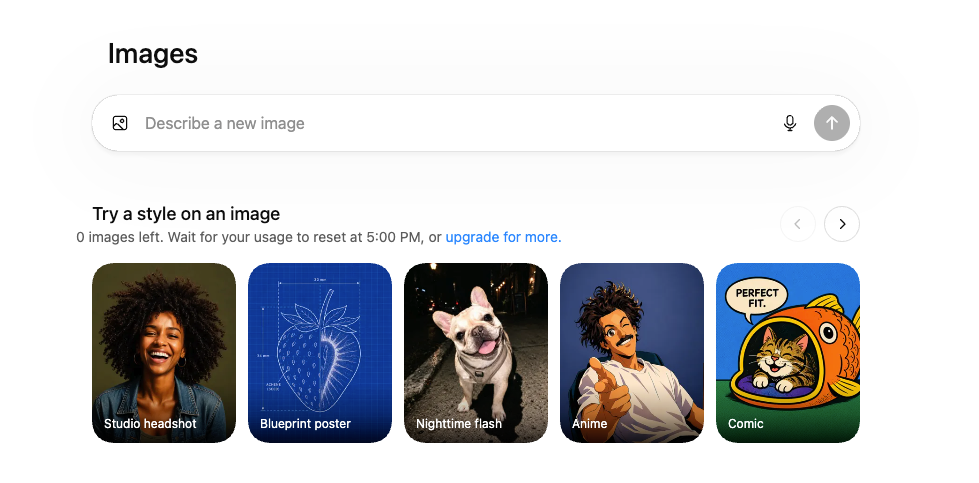

Acesso — Plano ChatGPT ou API

O GPT Image 2 está disponível no ChatGPT (web e celular) e via endpoints de imagem da API da OpenAI. Todos os usuários do ChatGPT têm acesso; usuários pagos (Plus, $20/mês) têm limites maiores de geração e opções de output mais avançadas. Pra trabalho criativo pontual, a interface do ChatGPT resolve. Pra quem produz em volume — 20+ clipes por semana — a API faz mais sentido em custo e fluxo.

Se quiser pular a configuração de API completamente, o fal.ai entrou ao vivo com acesso oficial ao GPT Image 2 em 21 de abril — sem lista de espera, uso comercial permitido desde o dia um.

Escolha um modelo I2V

Esse é o cenário atual pra criadores de conteúdo short-form (dados verificados em abril de 2026):

Modelo | Melhor pra | Créditos / Exemplo de Output | Vertical nativo? | Minha pontuação pra Shorts (1–10) |

Conteúdo social geral, produtos, consistência de movimento | ~33–150 clipes padrão de 5–10s/mês | Sim | 9.4 | |

Sujeitos humanos, expressões faciais, talking-head | ~40 clipes de 6s em 1080p | Sim | 9 | |

Wan 2.6 (Alibaba) | Produção em volume com orçamento reduzido | Alto volume de rascunhos com menor custo | Sim | 8.2 |

Seedance v1.5 / 2.0 Pro | Narrativa, histórias em múltiplos planos | Mid-tier competitivo | Sim | 8.5 |

Runway Gen-4.5 | Movimentos de câmera de alta fidelidade, polimento final | Premium, mas consome créditos | Sim | 8.8 |

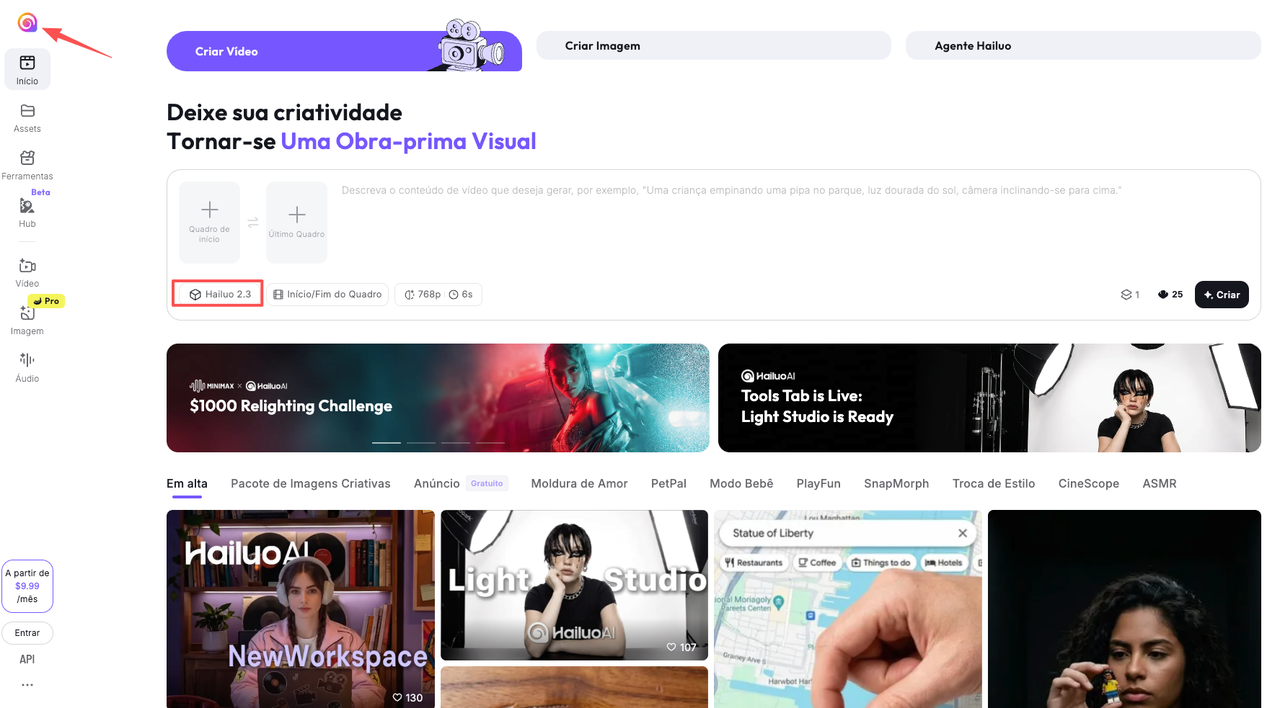

Meu stack atual (abril de 2026): Kling 3.0 pra 70% do trabalho inicial com produtos; Hailuo 2.3 sempre que tem humano ou rosto no frame; Wan 2.6 ou Runway Gen-4.5 pra rascunhos rápidos ou polimento final de alto nível.

Defina o formato desde o início — 9:16 pra Shorts, 1:1 pra Feed

Sempre gere seu frame no GPT Image 2 já no formato final da plataforma: 1080×1920 (9:16) pra TikTok/Shorts/Reels, 1080×1080 (1:1) ou 1080×1350 (4:5) pro feed. O modelo compõe de forma inteligente pra proporção que você especifica.

Passo a passo — do prompt ao short publicado

Passo 1: gere o frame de origem no GPT Image 2

Fórmula de prompt que consistentemente produz frames prontos pra I2V:

"[Sujeito] em [ângulo principal], [elementos de texto exatos e posicionamento], iluminação de estúdio limpa, camadas de profundidade, movimento implícito, [proporção] 1080×1920, fotorrealista, estilo de fotografia comercial de produto."

Gere 3 a 4 variantes. Escolha a que tem a lógica de movimento mais clara — não necessariamente a mais bonita estaticamente.

Passo 2: exporte na resolução certa pra I2V

Baixe como PNG de alta qualidade (mínimo 1024×1024, idealmente 1080×1920 nativo). Comprima levemente se necessário (limite de upload do Kling Web ~20 MB). Use ImageOptim ou TinyPNG — a perda de qualidade pra fonte de vídeo é insignificante.

Passo 3: alimente seu modelo I2V com um motion prompt

Faça upload do frame no seu modelo I2V. A maioria das plataformas te dá um campo de texto pra "motion prompt" junto ao input de imagem. É aqui que você descreve o que deve acontecer — não como a cena aparece (a imagem já cobre isso).

Estrutura eficaz de motion prompt: sujeito + direção do movimento + movimento de câmera + atmosfera + ritmo.

Exemplo: "Frasco do produto gira lentamente pra esquerda, iluminação suave de estúdio, brilho delicado na superfície de vidro, câmera estática, suave e lento"

Prompts genéricos tipo "faz mover" ou "anima isso" não funcionam. O modelo precisa de direção de movimento pra gerar algo coerente.

Passo 4: gere 2 a 4 clipes candidatos e escolha um

Mesma imagem + mesmo prompt ainda produz variância real. Escolha o clipe que melhor preserva a legibilidade do texto e a física natural. Minha taxa de re-edição caiu de ~60% pra ~25% depois de travar templates de prompt.

Passo 5: monte, adicione legendas e corte o ritmo

Importe no CapCut, Premiere ou DaVinci (gratuito). A maioria dos shorts vai de 8 a 15 segundos. Repita ou una múltiplos clipes se necessário.

Importante: se o texto distorceu durante o I2V, delete o texto embutido e sobreponha legendas novas e bem espaçadas. Isso virou prática padrão agora.

Passo 6: exportação para plataforma — TikTok/Shorts/Reels

Especificações das plataformas em abril de 2026:

Plataforma | Proporção | Resolução | Duração máx | Exportação recomendada |

TikTok | 9:16 | 1080×1920 | 10 min | MP4, H.264, 30–60 fps, ≤72 MB |

YouTube Shorts | 9:16 | 1080×1920 | 3 min | MP4, H.264, 30–60 fps |

Instagram Reels | 9:16 | 1080×1920 | 90 seg | MP4, H.264, 30 fps |

Instagram Feed | 1:1 ou 4:5 | 1080×1080 | 60 seg | MP4, H.264 |

Padrões de prompt que sobrevivem ao handoff imagem→movimento

Escolhas de composição que o GPT Image 2 deve fazer pra facilitar o I2V

Nem toda imagem anima igualmente. Algumas coisas que consistentemente produzem resultados melhores no I2V:

Camadas de profundidade claras. Um sujeito no primeiro plano com um fundo distinto dá ao modelo I2V um paralaxe de movimento pra trabalhar. Composições planas produzem animações planas.

Direção de movimento implícita. Uma pessoa no meio de um gesto, um produto com derramamento ou respingo congelado no tempo, tecido preso no vento — esses elementos dão ao modelo I2V uma trajetória óbvia pra continuar.

Texto ancorado em uma zona. Se sua imagem tem texto legível, posicione-o num canto ou no terço inferior, onde pode ser mascarado durante a animação. Texto no centro de uma cena dinâmica é receita pra problema de distorção.

Evite detalhes extremos em zonas de movimento. Cabelo, pelo e superfícies líquidas com padrões complexos tendem a produzir artefatos quando animados.

Motion prompts que combinam bem com outputs do GPT Image 2

Para produtos: "[Produto] gira lentamente [direção], [descrição de iluminação], câmera estática, fotorrealista"

Para talking-head: "[Sujeito] vira levemente a cabeça pra câmera, movimento natural de respiração, fundo suavemente desfocado, cinematográfico"

Para paisagens/ambientes: "Dolly lento avançando em [cena], [descrição atmosférica], sem trepidação de câmera, suave"

Quanto mais específico o prompt, menor a variância — e pra conteúdo short-form onde você publica com frequência, consistência supera genialidade ocasional.

Pontos de falha mais comuns

Texto da imagem distorcendo quando o movimento começa

Esse é o que mais frustra as pessoas. A renderização de texto do GPT Image 2 é um dos seus pontos fortes. Mas essa vantagem praticamente desaparece quando você passa a imagem pelo I2V.

Modelos I2V tratam texto como textura visual, não como conteúdo semântico. Quando a cena se move, o texto distorce como qualquer outra região de pixel.

Dois jeitos de resolver. Primeiro, estruture seu prompt no GPT Image 2 pra que o texto crítico fique numa área que você pretende mascarar — barras de letterbox, terços inferiores. Durante o I2V, essas zonas se movem menos. Segundo, delete o texto renderizado do output I2V e re-adicione como overlay limpo no seu editor. Essa é a abordagem mais confiável e te dá melhor controle de legibilidade em diferentes tamanhos de tela.

Desalinhamento de proporção entre imagem e I2V

A maioria das plataformas I2V tem restrições de proporção. Algumas aceitam input 9:16 mas internamente preenchem ou cortam antes da geração. Verifique as dimensões reais aceitas pela sua plataforma I2V antes de gerar seu frame de origem. O Kling lida bem com input vertical nativamente. Algumas outras plataformas ainda retornam output 16:9 mesmo quando você alimenta com uma fonte vertical.

Drift de personagem em sequências de múltiplos planos

Se você estiver criando um vídeo com múltiplos clipes, vai esbarrar no drift de personagem. Um personagem que aparece de um jeito no clipe 1 fica visivelmente diferente no clipe 3, mesmo usando a mesma imagem de origem em todos. Modelos I2V não têm memória persistente de personagem entre chamadas de geração separadas.

Soluções parciais: use o último frame de um clipe como imagem de origem do próximo — a maioria das plataformas suporta controle de primeiro e último frame. Ou corte rápido o suficiente pra que os espectadores não comparem. Cortes abaixo de 2 segundos tornam o drift muito menos perceptível.

Três receitas práticas pra short-form

Receita 1: short estilo talking-head / avatar

Caso de uso: conteúdo de criador, comentários, compartilhamento de conhecimento

Gere um frame de retrato no GPT Image 2 em 9:16. Prompt pra uma pessoa no meio de uma frase, iluminação natural, fundo neutro, leve inclinação da cabeça.

Alimente no Hailuo 2.3 com motion prompt: "Sujeito falando naturalmente pra câmera, movimento sutil de cabeça, olhos acompanhando pra frente, respiração natural, luz ambiente quente"

Gere 3 candidatos. Escolha o que tem o movimento ocular mais natural.

Adicione legendas como overlay de texto. Adicione música de fundo em volume baixo.

Exporte em 1080×1920.

Taxa de re-edição esperada: 30–40% na primeira passagem. Animação talking-head ainda é inerentemente complicada — o movimento de boca raramente sincroniza perfeitamente sem guia de áudio.

Receita 2: short de demonstração de produto

Caso de uso: e-commerce, afiliados, review UGC de produto

Gere um produto em 1:1 ou 9:16. Prompt pra ângulo principal, fundo limpo. Mantenha qualquer texto de rótulo no terço inferior.

Alimente no Kling 3.0 com motion prompt: "Produto gira lentamente pra esquerda, iluminação de estúdio, reflexo suave na superfície, câmera estática"

Na edição, re-adicione qualquer texto do produto como overlay limpo — não confie na versão animada.

Adicione um frame de CTA no final (um frame estático do GPT Image 2 funciona aqui).

Tempo total de produção com o fluxo alinhado: 18–25 minutos por clipe.

Receita 3: história em 3–5 planos

Caso de uso: conteúdo narrativo, skits, mini-histórias

Gere 3–5 frames representando os momentos-chave da história. Use descrição consistente de personagem em todos os prompts.

Anime cada frame independentemente. Use o último frame de cada clipe como origem do próximo sempre que possível.

Monte no seu editor. Mantenha cada plano abaixo de 3 segundos pra mascarar o drift de personagem.

Adicione legendas como overlays, não queimadas no vídeo.

Adicione áudio — narração gravada ou gerada por IA. Nessa duração de clipe, a sincronia não precisa ser perfeita.

O problema do drift é real no trabalho de múltiplos planos. Já tive sequências de três planos onde o personagem parecia duas pessoas diferentes no terceiro clipe. A regra do corte abaixo de 2 segundos resolve a maioria dos casos. Quando não resolve, gere novamente o último clipe usando o último frame do anterior como origem.

Licenciamento e divulgação nas plataformas

A política da OpenAI é que por padrão não treina com dados de clientes via API, e todos os outputs de imagem estão sujeitos às políticas de uso da API deles. Pra uso comercial via API, imagens geradas estão disponíveis pra projetos comerciais — verifique os termos atuais antes de escalar uma campanha.

Segundo a documentação de implementação C2PA da OpenAI, imagens geradas com ChatGPT incluem metadados incorporados seguindo o padrão C2PA — um padrão técnico aberto que registra a origem e o método de criação da imagem. Isso é detectável via Content Credentials Verify. Vale notar: esses metadados C2PA da imagem de origem não são transferidos automaticamente pra um clipe de vídeo gerado — o modelo I2V produz um novo arquivo sem proveniência herdada do PNG de origem. A imagem de origem ainda carrega os metadados se você a mantiver.

A maioria das principais plataformas exige agora divulgação de conteúdo gerado por IA. Requisitos de rotulagem de conteúdo IA do TikTok e YouTube são obrigatórios. Adicione sua divulgação na legenda ou via o rótulo de IA nativo da plataforma — não pule essa etapa.

Perguntas frequentes

O GPT Image 2 gera vídeo diretamente? Não — é um modelo de imagem estática. O passo I2V é separado.

Por que o texto distorce quando animado? O I2V trata cada pixel como textura. Sobreponha em pós-produção pra legibilidade perfeita.

Quanto tempo esse fluxo realmente leva? De 20 a 40 minutos de ponta a ponta com templates travados. O tempo de decisão ativa é ~10 minutos.

Conclusão

O GPT Image 2 é genuinamente útil pra conteúdo short-form — melhor renderização de texto, maior controle de composição, bom output em múltiplos formatos. Mas é a primeira metade de um fluxo, não o fluxo inteiro.

O pipeline é: gere o frame de origem → exporte na resolução certa pro I2V → anime com modelo I2V → revise os candidatos → edite e adicione legendas → exporte pra plataforma.

Distorção de texto é o problema mais comum e o mais fácil de resolver — mantenha texto importante em zonas de baixo movimento e re-adicione texto crítico como overlay em pós. Drift de personagem em sequências de múltiplos planos é mais difícil; cortes rápidos e continuidade de último frame são as melhores soluções parciais por enquanto.

Vale construir no seu fluxo se você produz short-form em qualquer volume real. Os custos de iteração são reais — não deixa ninguém te convencer que isso é produção de um clique. Mas uma vez alinhado, o ganho de tempo vai se acumulando. Você vai agradecer pra si mesma depois.

Leituras Recomendadas

HappyHorse vs Kling 3.0 vs Veo 3.1: Qual modelo de IA é melhor pra criadores de conteúdo?

LTX 2.3 Image to Video: Transforme fotos de produto em clipes curtos

Wan 2.7 com 9-Grid Image-to-Video pra criar vídeos de produto em escala