GPT Image 2 vs Midjourney: qual realmente serve pra quem faz vídeo curto?

Oi, sou a Mariana. Uma vez um cliente me pediu 30 clipes de produto em cinco dias. Fiz tudo na mão — cada imagem garimpada, cada frame composto um por um. Nunca mais.

Foi essa experiência que me fez levar geração de imagem a sério como ferramenta de fluxo, não como brinquedo criativo. E agora dois nomes não saem da minha cabeça: GPT Image 2 e Midjourney. Não porque são perfeitos em tudo — mas porque criadores de todos os níveis estão tentando descobrir qual deles realmente pertence a uma stack de produção.

Isso aqui não é concurso de beleza. Não me interessa qual gera imagens mais bonitas no vácuo. Me interessa qual produz outputs que sobrevivem à próxima etapa — animação, variações de anúncio, storyboards, overlays de produto — sem te mandar de volta à estaca zero. Esse é o único critério que importa.

Por que essa comparação importa pra quem faz conteúdo

A imagem é o começo do fluxo, não o fim

A maioria das comparações de ferramentas para na pergunta "qual fica mais bonita". Essa é a pergunta errada se você está produzindo conteúdo em volume.

Pra criadores que fazem 5 a 10 vídeos por dia — ou times pequenos entregando criativos pra vários clientes — a imagem é um ativo intermediário. Ela vai ser animada, recortada pro 9:16, jogada em um template, coberta de texto, ou passada pra um gerador de vídeo. A questão não é qual vence esteticamente. É: o quanto esse output aguenta a próxima etapa?

GPT Image 2 e Midjourney representam duas filosofias genuinamente diferentes sobre o que geração de imagem serve pra fazer. Entender essa diferença é o único jeito de evitar pagar pela ferramenta errada.

Comparação rápida

Dimensão | GPT Image 2 | Midjourney V8 |

Texto em imagens | +95% de precisão em Latin, CJK, árabe | Melhorou no V8 alpha, ainda inconsistente em múltiplas linhas |

Edição de foto real | Sim — inpainting, remoção de objeto, troca de fundo | Sem edição nativa de foto |

Consistência de estilo | Moderada — depende do prompt | Forte — sistema --sref e --cref |

Velocidade de geração | 15–45s padrão; Thinking mode adiciona latência | Abaixo de 10s no V8 alpha |

Acesso | ChatGPT Plus (US$20/mês), Pro, API (abre maio 2026) | App web, Discord; sem API pública oficial |

Direitos comerciais | Incluídos nos planos pagos | Incluídos nos planos pagos (grátis excluído) |

Entrada de preço | US$20/mês (ChatGPT Plus) | US$10/mês (Basic) |

Batch / automação | API-native, scriptável | Sem API pública oficial — só wrappers não oficiais |

Upload de imagem | Sim, nativamente pra edição | Referência de estilo (--sref), sem edição direta |

Nenhuma ferramenta vence em todas as linhas. A tabela reflete onde cada uma performa de verdade — com base em seis semanas de testes em criativos de anúncio, mockups de produto e hooks visuais pra short-form, mais cruzamento com benchmarks disponíveis.

Onde o GPT Image 2 vence

Texto dentro da imagem e edição de foto real

Aqui o GPT Image 2 está genuinamente à frente — e não por pouca margem.

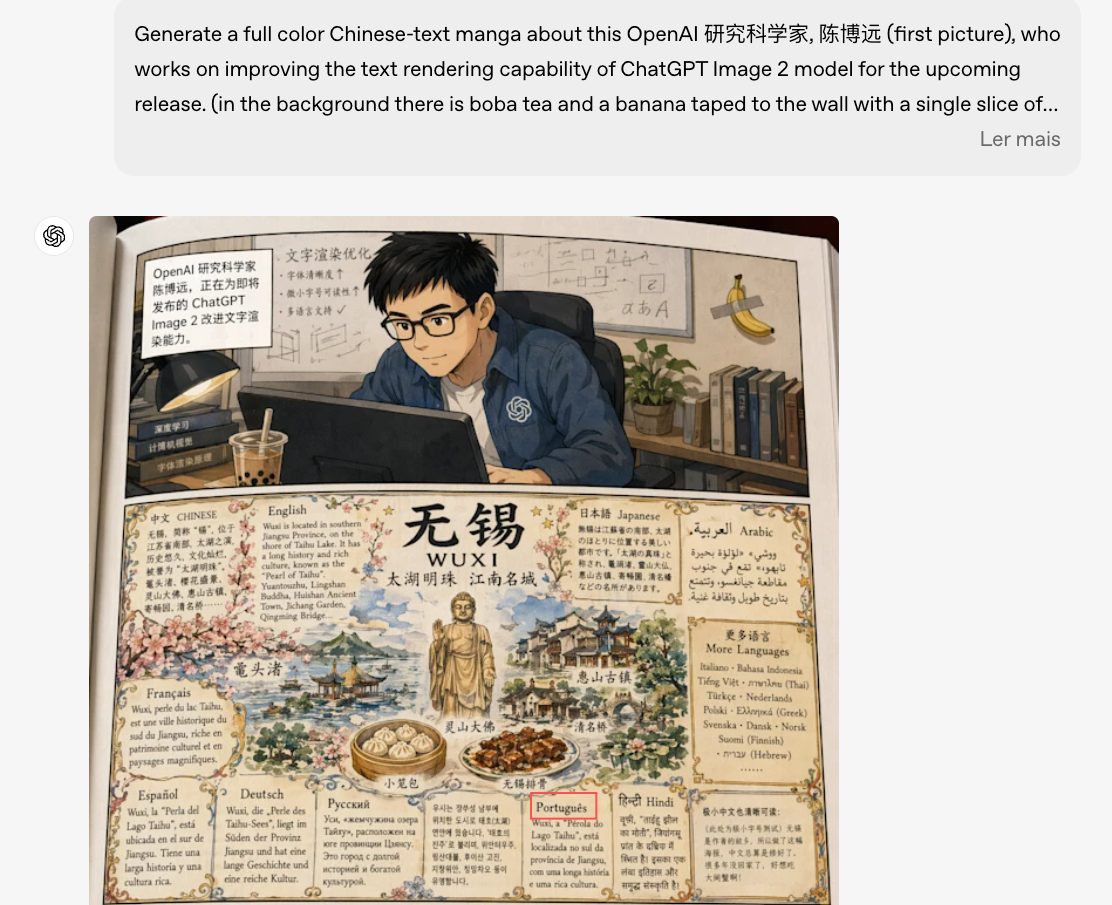

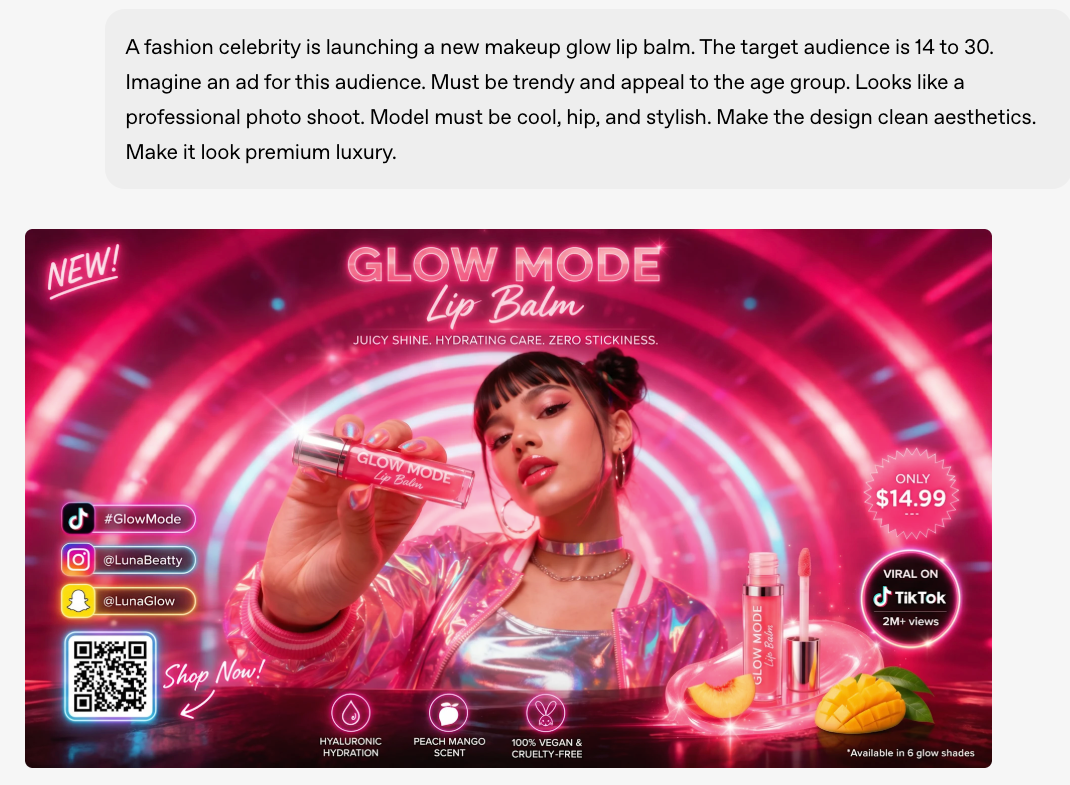

Texto em imagens. Callouts de produto, etiquetas de preço, banners promocionais, texto de hook sobreposto — o GPT Image 2 entrega isso com uma consistência que o Midjourney ainda não consegue igualar. Segundo o anúncio oficial do ChatGPT Images 2.0, a precisão de renderização de texto passa de 95% em scripts latinos, chinês, japonês, coreano, hindi, bengali e árabe. É a primeira vez que um modelo comercial atinge esse patamar. Múltiplos reviewers independentes confirmaram o mesmo número rodando seus próprios sets de prompts.

Nos meus testes com 40 prompts de texto em imagem, cerca de 37 voltaram com texto legível e sem erro ortográfico na primeira geração. O Midjourney V8, mesmo com as melhorias, acertou cerca de 22. Essa diferença importa muito quando você está produzindo criativo em volume.

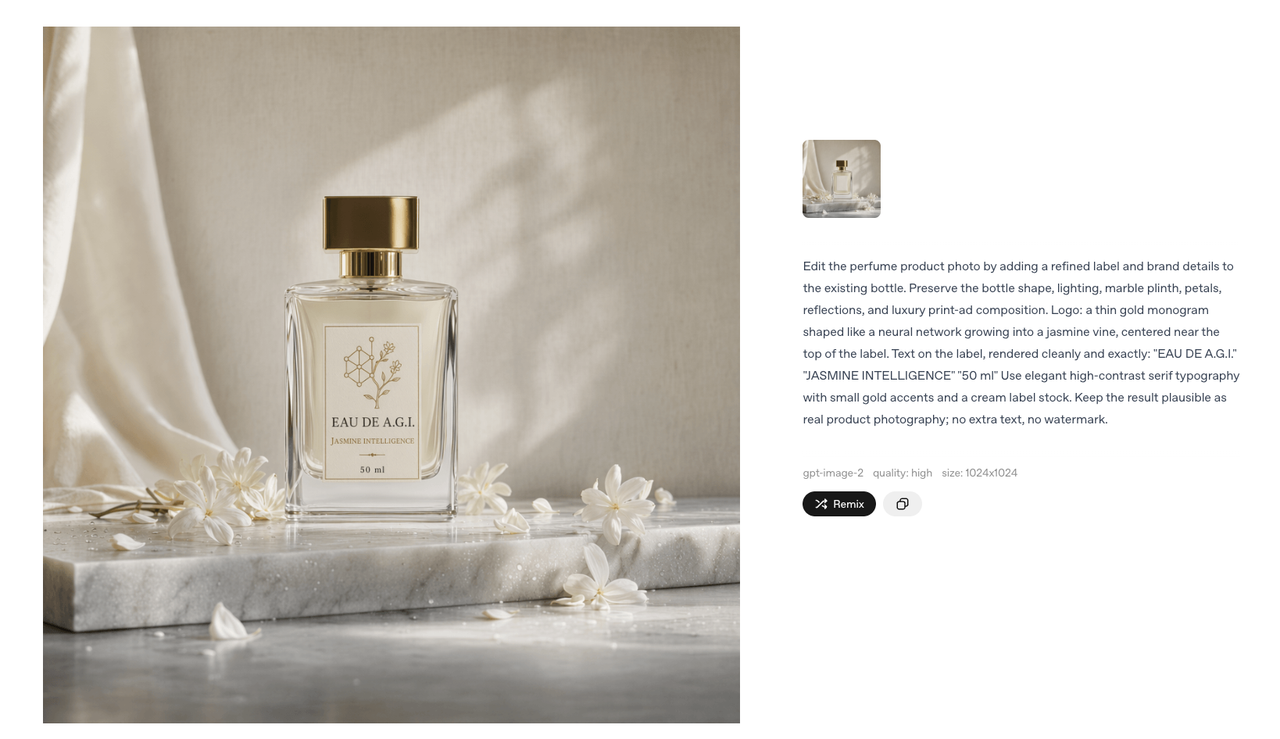

Edição de foto real. Você faz upload de uma foto de produto e pede pro GPT Image 2 mudar o fundo, remover um objeto perdido ou ajustar a iluminação — em linguagem natural, sem precisar de máscara. O output nem sempre é perfeito; artefatos de inpainting aparecem mais do que eu gostaria em bordas complexas. Mas funciona pra maioria dos casos de anúncio. A documentação oficial da API de geração de imagens da OpenAI confirma que inpainting, outpainting e edição em nível de objeto foram construídos como capacidades centrais desde o início — não adicionados depois.

Menos troca de ferramenta. Se o seu fluxo é "gerar imagem → adicionar texto → ajustar → exportar pra vídeo", o GPT Image 2 consegue colapsar as etapas 1 a 3 em uma sessão dentro do ChatGPT. Isso economiza tempo real quando você repete esse loop 20 vezes por dia.

Fluxos com menos troca de ferramenta

A história da API é onde a diferença fica séria pra quem roda fluxos com templates ou gerencia vários clientes.

A API pública completa do GPT Image 2 abre pra desenvolvedores no início de maio de 2026. Até lá, assinantes do ChatGPT e Codex têm acesso direto. O Midjourney, por outro lado, ainda não tem API pública oficial em abril de 2026 — o acesso via API é restrito a contas Enterprise, sem sistema de chave pública ou endpoints documentados pra assinantes padrão. Times que precisam fazer batch scriptado, conectar a um CMS ou passar outputs pra uma stack de edição ficam dependendo de wrappers não oficiais — o que adiciona custo, risco de instabilidade e uma camada de dependência que você não controla.

Pra criador solo isso pode não importar. Pra quem gerencia 10+ clientes ou roda conteúdo de ecommerce contra um catálogo, importa muito.

Onde o Midjourney ainda vence (ou é diferente)

Ideação visual e exploração de estilo

É aqui que o Midjourney ainda se destaca.

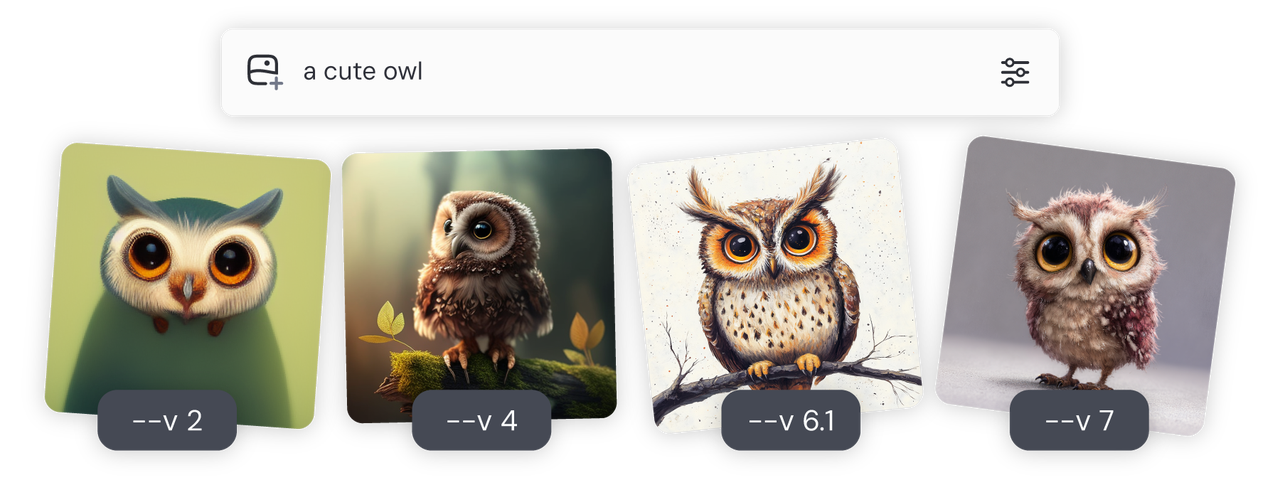

Quando o objetivo é explorar direções visuais — não executar um template fixo — ele produz resultados mais variados e mais intencionais. As imagens não parecem só geradas. Elas parecem projetadas.

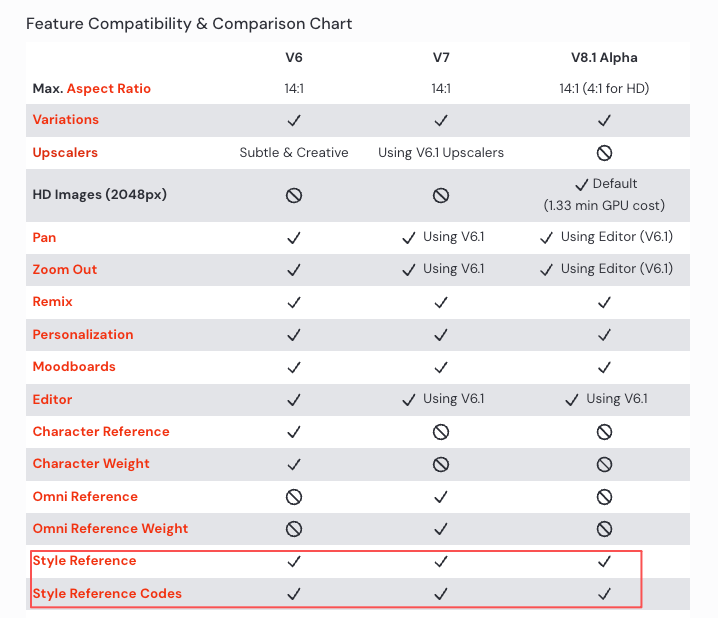

O sistema de referência de estilo (--sref) do Midjourney faz muita diferença. Você trava uma identidade visual em um batch inteiro usando uma única imagem de referência, sem reescrever a estética toda vez. Pra conteúdo orientado a marca, isso sozinho pode justificar a assinatura.

Eu estava cética sobre o quanto isso importava pro short-form. Depois de seis semanas: importa — mas em casos específicos. Moodboards, pitches de conceito, exploração inicial — o Midjourney te leva a "opções interessantes" mais rápido.

O V8, conforme as notas de lançamento oficiais do V8 Alpha publicadas em março de 2026, também melhorou renderização de texto e aderência a prompts. Não é mais o ponto fraco que era no V6. Mas ainda fica atrás do GPT Image 2 em texto complexo e qualquer coisa que envolva edição de foto real.

Quando estética importa mais do que editabilidade

Alguns formatos de conteúdo dependem de impressão visual antes de qualquer texto ou movimento ser adicionado. Moda, marcas de lifestyle, estética de fotografia de produto de alto padrão — o Midjourney produz outputs que são mais difíceis de distinguir de fotografia profissional quando o prompt está bem construído. Os instintos de composição são diferentes do GPT Image 2: mais intencionais, mais estilizados, menos "comercial polido" e mais "projetado".

O GPT Image 2 produz imagens limpas, competentes, fotorrealistas. Raramente produz imagens que param o scroll só pelo mérito estético. Essa diferença é real e vale saber.

Handoff pra vídeo: o que acontece na prática

Esse é o teste que a maioria das comparações pula. É o que mais importa se o vídeo é o entregável final.

Rodei outputs de ambas as ferramentas em dois pipelines de I2V ao longo de três semanas, rastreando: com que frequência a animação introduzia distorção (face warping, colapso de fundo, movimento não natural), e quanto cleanup manual era necessário antes de o clipe estar utilizável.

Outputs do GPT Image 2: bordas mais limpas, iluminação interna mais consistente, coerência fotorrealista que modelos de I2V conseguem trabalhar de forma mais previsível. Elementos de texto distorceram no início da animação — geralmente no primeiro segundo — mas fundos e formas de produto se mantiveram bem. Taxa de re-edição nos outputs do GPT Image 2: cerca de 25% precisaram de cleanup manual significativo antes de estar prontos pra exportar.

Outputs do Midjourney: frames iniciais esteticamente mais fortes. Mas outputs muito estilizados ou pictóricos causaram artefatos de movimento com mais frequência — a textura que faz uma imagem do Midjourney parecer ótima como still é frequentemente a mesma coisa que causa instabilidade quando o movimento é aplicado. Taxa de re-edição nos meus testes: cerca de 42% precisaram de cleanup, maior em outputs com textura complexa ou renderização estilo ilustração.

Isso não é uma regra universal. Os resultados variam por gerador de I2V. Teste com sua ferramenta real antes de comprometer qualquer modelo a um pipeline de produção.

Variações de anúncio e storyboards

Pra produção de variações de anúncio — mesmo produto, hooks diferentes, fundos diferentes, textos diferentes — o GPT Image 2 vence na praticidade. Upload de uma foto base do produto, gerar 6 a 8 variações de fundo e iluminação via inpainting, adicionar texto de hook na mesma sessão, exportar. É uma ferramenta pra o que antes precisava de três.

Meu fluxo atual parece assim: uma foto limpa do produto como âncora → GPT Image 2 pras variações de fundo e callouts de texto → pipeline de I2V pro passo de animação → NemoVideo pro corte e camada de legenda. O loop inteiro, uma vez com template, roda em menos de 40 minutos pra um batch de 8 variações. Antes do GPT Image 2, só a etapa de prep de imagem levava esse tempo.

Pra storyboards e ideação de campanha — onde você está apresentando direções visuais pra um cliente antes de travar qualquer coisa — o Midjourney é mais rápido em gerar frames conceitualmente distintos. O range estético é mais amplo, e os outputs parecem mais opções criativas genuínas do que execuções de um mesmo briefing técnico.

Qual escolher: por tipo de criador

Criador solo

Se você produz conteúdo sozinho e o seu fluxo termina em um vídeo publicado, a pergunta é simples: com que frequência você precisa de texto nas suas imagens, e com que frequência você edita fotos reais?

Se a resposta é "com frequência" — GPT Image 2 é a ferramenta principal. Se você está principalmente em modo de ideação ou construindo uma identidade visual de marca e suas necessidades de texto são mínimas — o Midjourney justifica o custo.

A maioria dos criadores solo não precisa das duas. Escolhe a que cobre a etapa do seu fluxo onde você perde mais tempo. Isso vai te dizer tudo.

Profissionais de marketing de marca

Times de marketing geralmente têm duas necessidades concorrentes: exploração criativa no início de uma campanha, e produção confiável de variações quando a direção está travada. É aqui que as duas ferramentas podem ter lugar — Midjourney pra moodboard e direção inicial, GPT Image 2 pra execução e iteração.

O custo é administrável — veja os planos e preços atuais do ChatGPT para confirmar os valores vigentes — e a divisão de fluxo é clara o suficiente pra justificar, desde que seu time consiga manter disciplina de prompting consistente nas duas ferramentas. Se isso for difícil, escolhe uma e constrói templates em torno dela.

Times de ecommerce e UGC

Aqui eu inclinaria mais fortemente pro GPT Image 2. A combinação de edição de foto real, renderização de texto e acesso via API mapeia diretamente no que conteúdo de ecommerce realmente exige: imagens de produto com callouts, variações de lifestyle a partir de uma única foto, criativo em escala contra um catálogo.

O posicionamento de lançamento da OpenAI pro GPT Image 2 citou especificamente varejo e ecommerce como casos de uso principais — e as features de inpainting e geração de variações se comportam consistentemente com essa intenção de design na prática.

Pra criadores de UGC que precisam mockar inserções de produto, criar imagens de referência pra overlays de talking-head, ou produzir variações por plataforma rapidamente — a capacidade de edição de foto do GPT Image 2 também é o fit mais forte. O Midjourney consegue gerar estéticas de produto convincentes a partir de prompts de texto, mas não edita a sua fotografia de produto existente.

Perguntas frequentes

Qual é melhor pra thumbnails? Depende do que suas thumbnails contêm. Thumbnails com muito texto (números, perguntas, callouts) — GPT Image 2. Thumbnails estética-primeiro com texto mínimo ou zero — Midjourney. Editar uma foto real sua contra um fundo diferente — GPT Image 2, sem concorrência.

Qual é melhor pra visuais de produto? GPT Image 2 pra maioria do trabalho de ecommerce. Você faz upload de fotos reais de produto e as edita diretamente. O Midjourney é melhor pra gerar cenas de produto estilizadas, mas não consegue modificar suas imagens existentes.

Qual serve melhor pra fluxos de imagem-pra-vídeo? Outputs do GPT Image 2 tendem a animar de forma mais limpa, especialmente pra conteúdo fotorrealista. Outputs estilizados do Midjourney podem introduzir artefatos sob animação. Teste os dois contra sua ferramenta de I2V específica antes de comprometer — os resultados variam o suficiente por gerador que afirmações gerais só chegam até certo ponto.

A maioria dos times precisa das duas? Geralmente não. Midjourney é melhor pra ideação, GPT Image 2 pra execução. Mas pra maioria dos criadores solo e times pequenos, uma ferramenta cobre 80–90% das necessidades, e adicionar as duas frequentemente só cria fricção de fluxo.

Conclusão

Nenhuma é universalmente melhor. São ferramentas diferentes pra momentos diferentes do mesmo fluxo.

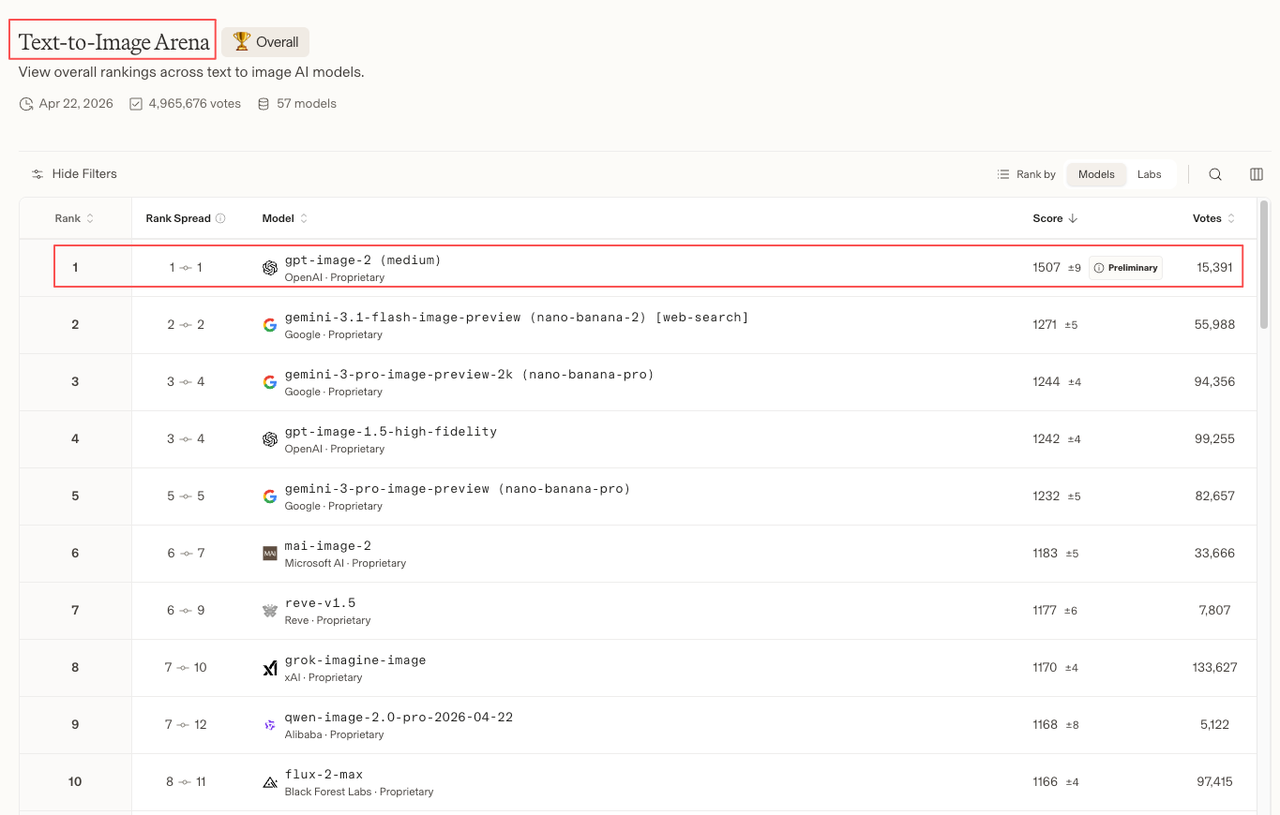

GPT Image 2 é a escolha mais forte quando seu fluxo envolve texto em imagens, edição de fotos reais, automação via API, ou alimentar um pipeline de vídeo com outputs limpos. No Image Arena leaderboard de text-to-image, pontuou 1.512 no lançamento — 241 pontos à frente do concorrente mais próximo, a maior liderança na história desse leaderboard. A melhoria de renderização de texto sozinha fecha uma lacuna que vinha frustrando criadores por três anos.

Midjourney V8 é a escolha mais forte quando você está em modo de exploração criativa, construindo uma marca visual consistente, ou produzindo conteúdo estética-primeiro onde a imagem é o produto final — não o input.

Escolhe com base em onde no seu processo você perde mais tempo. Essa é a pergunta que tem resposta de verdade — não qual parece mais impressionante no demo de outra pessoa.

Você usa uma das duas no seu fluxo hoje? Me conta nos comentários qual etapa ainda te trava mais — quero saber se a dor que eu sentia ainda é a mesma de quem tá começando agora.

Leituras Recomendadas

GPT Image 2 para Vídeos de Produto em E-commerce em 2026

GPT Image 2: O que ninguém te conta sobre o custo real pra criadores em 2026

GPT Image 2 vs Nano Banana Pro: qual delas serve melhor pra quem faz vídeo?