GPT Image 2 pra anúncios multilíngues em vídeos curtos

Tive um cliente que pediu 30 clipes curtos pra um lançamento de produto em três mercados — inglês, português e espanhol. No modo manual, seriam dois dias inteiros reconstruindo o mesmo card no Canva, colando traduções, ajustando tamanho de fonte, exportando de novo. Nunca mais.

O que realmente mudou foi a renderização de texto do GPT Image 2. Não de forma dramática, não magicamente — mas o suficiente pra meu fluxo de criação de assets estáticos ter uma cara completamente diferente agora.

Oi, gente! Sou a Mariana. E se você produz anúncios multilíngues em vídeo curto com algum volume real, é aqui que a coisa começa a importar de verdade: quais assets realmente se beneficiam da geração de imagem com IA, quais não, e onde você ainda vai precisar fazer o trabalho manual.

Por que o GPT Image 2 importa agora pra criadores multilíngues

A renderização de texto muda o trabalho de localização

Tem uma coisa que ninguém te conta sobre texto em imagens geradas por IA: antes do GPT Image 2, colocar texto em outro idioma num prompt era um jeito garantido de receber resultado embaralhado. Acento sumia. Caractere corrompido. O português brasileiro saía parecendo bilhete de sequestro.

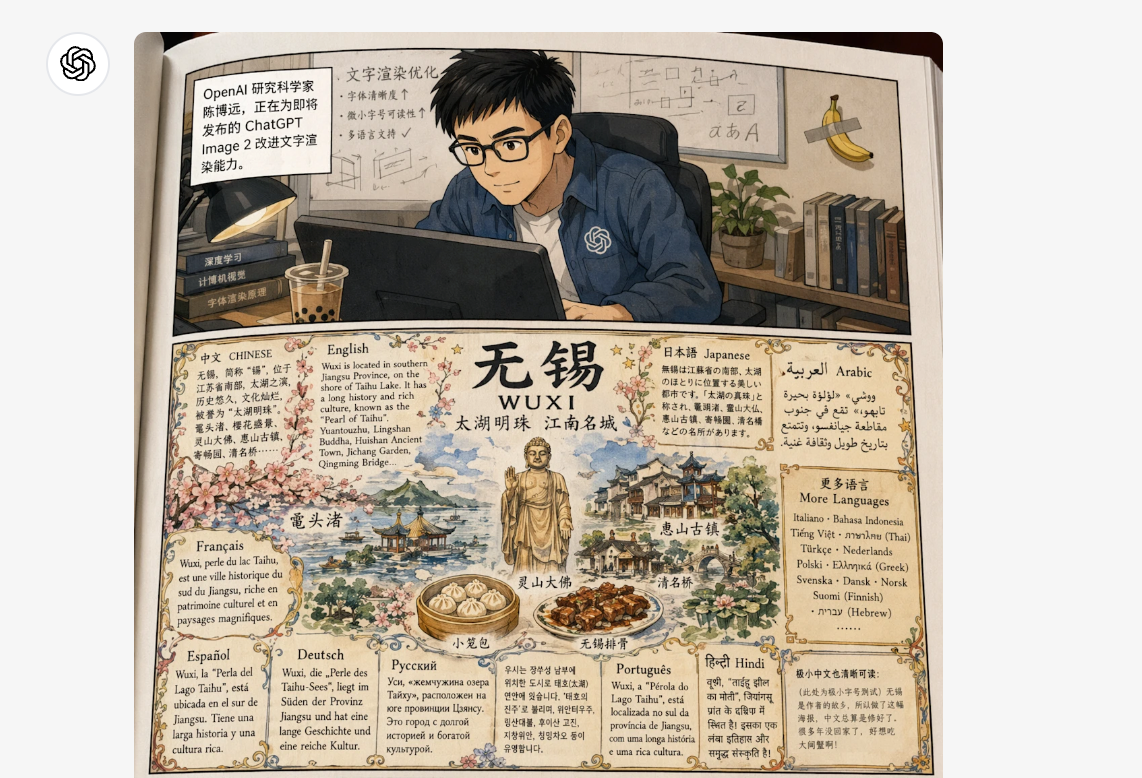

O GPT Image 2 lida com isso muito melhor. O anúncio de lançamento do ChatGPT Images 2.0 confirma que renderização de texto aprimorada e suporte multilíngue foram upgrades centrais nessa versão. Nos meus testes com inglês, português, espanhol e japonês, a legibilidade foi consistente pras línguas com escrita latina. Scripts CJK (chinês, japonês, coreano) funcionaram na maioria dos casos, mas exigiram mais iteração — e eu ainda verificaria com falante nativo antes de publicar.

Dito isso: "melhor do que antes" não é "perfeito". Roda, lê, pede pra alguém do mercado checar antes de aprovar.

A página oficial do modelo gpt-image-2 descreve o sistema como feito pra tarefas visuais complexas com forte seguimento de instrução — o que, pra criadores, inclui assets multilíngues onde legibilidade de texto não é opcional.

Onde imagem estática ajuda mais do que legenda sozinha

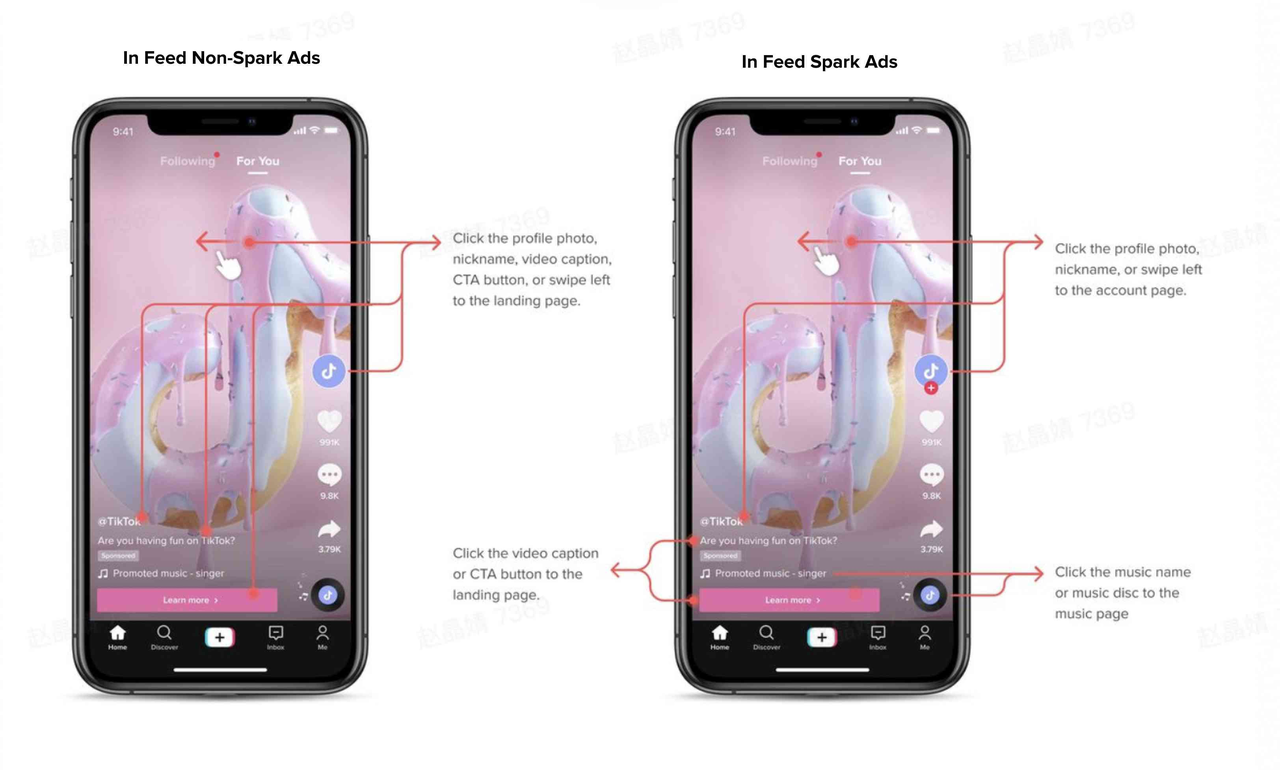

Anúncios em vídeo curto têm um problema estrutural: legendas aparecem e somem. Cards de capa e frames finais, não. Quando um usuário pausa ou faz print do seu anúncio, o texto congelado na tela é o que ele lê. Esse é o momento em que um texto traduzido bem posicionado numa imagem faz um trabalho que legenda automática não consegue.

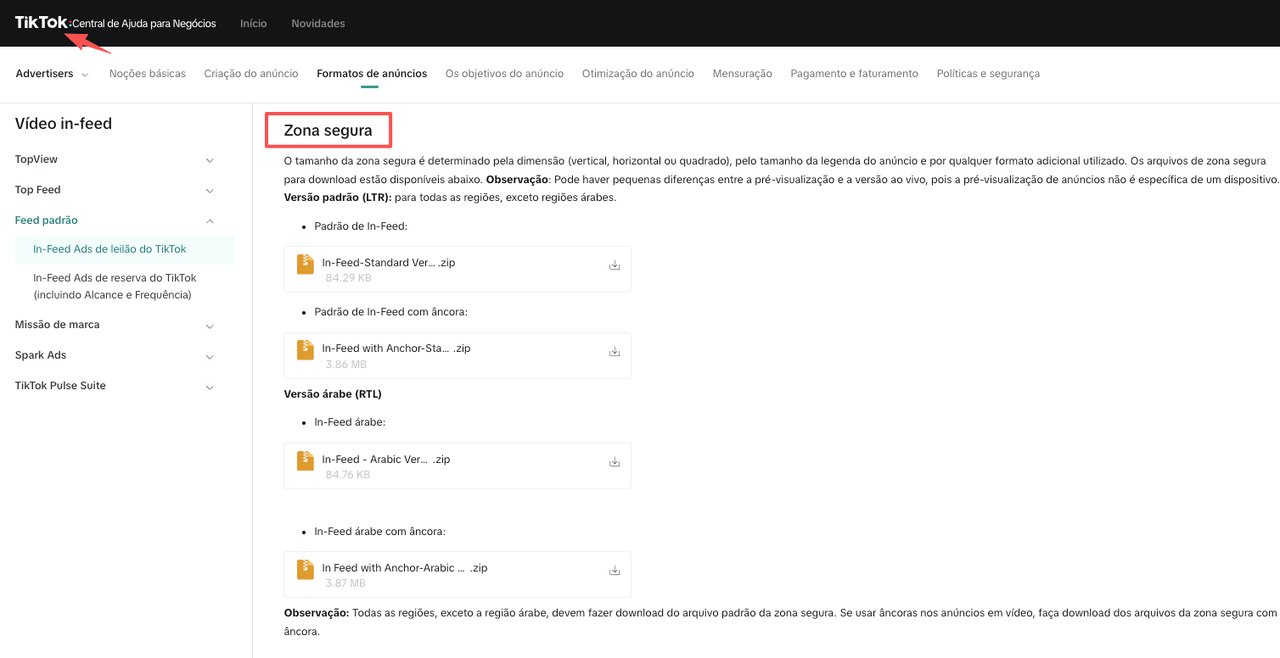

Isso vale também pra zonas seguras de plataforma. Se você já viu uma legenda desaparecer embaixo dos elementos de UI do TikTok, já entende por que design de asset estático pra mercados multilíngues é um problema separado do trabalho de legenda — e por que as duas camadas precisam ser planejadas de forma independente.

Os melhores assets multilíngues pra criar com GPT Image 2

Cards de capa e frames de abertura

O primeiro frame de um anúncio em vídeo curto funciona como thumbnail. O usuário decide se passa ou fica em menos de um segundo. Um card de capa localizado — com a língua do mercado, hierarquia visual certa e texto legível — supera um genérico consistentemente.

Com o GPT Image 2, eu gero o card em inglês primeiro, confirmo a composição, depois reprocesso com o texto traduzido no prompt. Leva uns 3 minutos por variação de mercado uma vez que o master em inglês está travado. Fonte e composição ficam razoavelmente consistentes entre gerações se você for preciso na estrutura do prompt.

Painéis de destaque e cards finais

Painéis de callout — "entrega em 3 dias", "frete grátis", "envío gratis" — são exatamente o tipo de asset de texto curto e alta visibilidade onde o GPT Image 2 se sai bem. O texto é curto o suficiente pra erros de renderização serem raros. A imagem não precisa carregar uma narrativa — só precisa ser legível e dentro da identidade visual.

Cards finais são parecidos. Se seu anúncio termina com um card de CTA, gerar variações de mercado aqui é baixo risco e alto retorno. A API de geração de imagem lida bem com isso quando você está trabalhando com 3 a 8 palavras — que deveria ser o limite máximo pra qualquer texto que você vai fixar num frame estático.

Variações de anúncio por mercado

Alguns mercados precisam de mais do que texto traduzido — precisam de contexto visual diferente. Um produto mostrado num ambiente que remete a "apartamento em São Paulo" vai performar de forma diferente de um que parece "casa de subúrbio americano". O GPT Image 2 permite que você ajuste o cenário pro mercado enquanto mantém o produto consistente — genuinamente útil pra times pequenos que não têm orçamento pra shoot separado por mercado.

Fluxo de trabalho pra localizar um criativo em múltiplos mercados

Master visual em inglês

Trave a versão em inglês completamente antes de tocar em qualquer outra coisa. Composição, posição do texto, zonas seguras e cor — tudo confirmado. Esse é o seu template. Cada variação de idioma é um derivado — se o master em inglês tem problema, todas as variações herdam.

Eu gero o master em inglês, faço print nas dimensões finais de exportação e marco as zonas de texto que vou trocar. Leva 10 minutos. Economiza uma hora depois.

Variações em português, espanhol e outros idiomas

Troca o texto no prompt. Mantém tudo o mais idêntico ou tão próximo quanto o modelo permite. A variável-chave é o comprimento do texto: português e espanhol tendem a ser mais longos do que o inglês pra expressar o mesmo significado. "Free shipping" é tranquilo. "Start your free trial today" vira "Comece seu teste gratuito hoje" — que pode extrapolar a sua caixa de texto.

Reserve 10 a 15% de espaço horizontal extra nas zonas de texto do seu master em inglês pra absorver isso. Se não fez — e já errei nisso mais de uma vez — vai ter que reconstruir a composição do zero.

Legendas no editor e exportação final

Aqui sou firme: diálogo, explicação de produto e qualquer coisa com mais de duas linhas fica na camada de legenda, não na imagem. A imagem cuida de identidade — marca, mercado, gancho. A camada de legenda cuida de informação. Misturar os dois piora os dois.

Seu software de edição cuida do timing e do burn-in das legendas. Mantém esses dois universos separados. As diretrizes WCAG sobre legendas pré-gravadas deixam isso claro: legendas acessíveis pertencem a uma camada dedicada que pode ser adaptada em contextos diferentes — não fixada em frames de imagem.

O que não localizar dentro da imagem

Linhas longas de legenda

Qualquer texto com mais de duas linhas curtas dentro de um frame é trabalho de legenda, não de imagem. Não tente renderizar frases completas ou blocos de legenda no GPT Image 2. O modelo vai tentar, mas em tamanhos de visualização mobile — onde a maioria das impressões de anúncio em vídeo curto acontece — texto multilinha dentro de uma imagem fica pequeno rápido. Vai reprovar em verificação de legibilidade em tamanho equivalente a 6pt numa tela de celular.

Cenas com muito movimento onde o texto vai distorcer

Se seu vídeo tem cortes rápidos, zooms ou efeitos de movimento aplicados na edição, qualquer texto fixado num frame de fundo vai distorcer com o movimento. É lógica básica de composição, mas pega quem está começando a integrar assets estáticos de IA em sequências com movimento. Mantém frames com texto estáticos ou com pan muito lento. Reserva o movimento pro seu B-roll e sequências de produto.

Verificações de qualidade antes de publicar

Precisão de idioma e adequação cultural

Vou ser direta: o GPT Image 2 não vai pegar erros idiomáticos. Ele renderiza o texto que você fornece. Se a tradução estiver errada, a imagem renderiza fielmente a tradução errada numa fonte legível. Isso é uma etapa de revisão humana, não de ferramenta.

Peça pra um falante nativo ou tradutor de confiança checar cada variação de mercado antes de publicar. Tradução automática é boa o suficiente pra um primeiro rascunho. Não é boa o suficiente pra um anúncio pago num mercado estrangeiro.

Pra scripts CJK especificamente — chinês, japonês, coreano — meus testes foram mistos. O modelo lida com eles na maioria dos casos, mas verifique a saída no idioma antes de publicar. O que posso dizer: não assuma que a confiabilidade de escrita latina se estende automaticamente pra outros sistemas de escrita.

Zonas seguras e legibilidade mobile

Toda plataforma tem elementos de UI que sobrepõem as bordas do frame. As especificações oficiais de anúncio In-Feed do TikTok confirmam que o tamanho da zona segura muda dependendo do formato do anúncio, comprimento da legenda e qualquer add-on interativo — o que significa que o espaço disponível pros seus assets de texto estático não é fixo.

Se você está gerando cards de capa ou frames finais sem levar isso em conta, o texto que você cuidadosamente localizou vai ficar embaixo de um nome de usuário ou botão de CTA. Confere seus assets gerados nas dimensões mobile reais antes de exportar. O que parece limpo em 1200px no desktop fica apertado em 390px no celular.

Perguntas frequentes

O GPT Image 2 é bom o suficiente pra texto em outros idiomas? Pra línguas com escrita latina — português, espanhol, francês, italiano, alemão — sim, de forma consistente o suficiente pra construir um fluxo de trabalho em cima. Pra árabe, scripts CJK ou línguas com regras de renderização complexas, testa antes de comprometer. A melhoria de renderização multilíngue é real; se é suficiente pro seu caso de uso específico, exige teste no seu conteúdo específico. Verifica antes de publicar em placements pagos.

Criadores devem localizar texto na imagem ou nas legendas? Nos dois — pra funções diferentes. Texto na imagem cuida de identidade: nome da marca, sinal de mercado, CTA curto. Legendas cuidam de conteúdo: explicação de produto, funcionalidades, termos da oferta. Misturar os dois cria problema de manutenção. Quando sua oferta mudar, você quer atualizar um arquivo de legenda, não regenerar 12 imagens específicas de mercado.

Quais mercados se beneficiam mais desse fluxo? Mercados onde você está investindo em mídia paga e já produz conteúdo em alta frequência. Se você posta 3 vídeos por semana, a abordagem manual ainda é gerenciável. Rodando 20+ variações de anúncio em 3 mercados ao mesmo tempo — é aí que a economia de tempo é real. Minha estimativa: 40 a 60% mais rápido na produção de assets estáticos uma vez que o fluxo está configurado. Seu resultado vai variar dependendo da complexidade da composição.

O que ainda precisa de revisão humana? Precisão de idioma, contexto cultural, conformidade com zona segura e — esse surpreende as pessoas — contraste de cor do texto em relação ao fundo gerado. O modelo às vezes renderiza texto branco sobre fundo quase-branco. Parece ótimo no preview, reprova nas verificações de contraste de acessibilidade na prática.

Conclusão

O GPT Image 2 é genuinamente útil pra localização de anúncios multilíngues em vídeo curto — especificamente pra assets de texto curto e alta visibilidade como cards de capa, painéis de callout e frames finais. Não é uma ferramenta de legenda, não é uma ferramenta de tradução, e não vai pegar erros culturais por você.

O fluxo que funciona: master em inglês primeiro, travado completamente. Variações geradas com texto traduzido trocado no prompt. Revisão humana de idioma antes de qualquer coisa ir ao ar. A camada de legenda cuida do resto.

Se você produz em volume em múltiplos mercados, vale testar. Se você trabalha com um mercado, em um idioma, ocasionalmente — seu fluxo de legenda atual provavelmente já resolve.

Roda num projeto real antes de se comprometer com o fluxo. Essa é sempre a jogada certa. Testou por aí? Me conta nos comentários qual mercado deu mais trabalho pra localizar — pego o mais votado pra testar na próxima.

Leituras Recomendadas

GPT Image 2 para Vídeos de Produto em E-commerce em 2026