GPT Image 2 pra Variações de Hook em Ads UGC

Oi, eu sou a Mariana. Produzo entre 40 e 60 vídeos short-form por semana, espalhados por várias contas. A ideação costuma ser o gargalo silencioso — ninguém fala dos 45 minutos gastos montando conceitos de abertura que às vezes nunca chegam nem a ser usados.

Quando o GPT Image 2 chegou em 21 de abril de 2026, minha primeira reação foi ceticismo. Já tinha visto ferramentas de imagem com IA prometendo muito e entregando pouco vezes demais pra me empolgar sem testar. Então rodei nos projetos de três clientes antes de formar qualquer opinião.

Os números reais foram esses: minha taxa de retrabalho em hook frames com IA caiu de 68% pra 31%, e passei a ter de 7 a 10 conceitos visuais testáveis por briefing em cerca de 20 minutos — contra os habituais 45 a 60. É sobre esse processo que esse artigo fala: o fluxo de trabalho, os tipos de hook que funcionam de verdade, e onde a ferramenta trava.

Por Que Variação de Hook Importa Mais do Que Um Único Anúncio Perfeito

Testar Bate Polir

O anúncio que levou três horas pra polir raramente performa melhor do que o que levou 40 minutos. Acompanhei isso por oito semanas nas minhas próprias contas e encontrei correlação praticamente zero entre tempo de edição e taxa de watch-through.

O motivo é estrutural. No TikTok e no Reels, o que o algoritmo mede é atenção inicial — thumb-stop rate, view-through nos 3 primeiros segundos, comportamento de scroll. Esses sinais dependem quase que inteiramente do seu frame de abertura, não de color grading ou qualidade de B-roll. Uma dados de campanhas UGC em marcas DTC mostrou que ads no estilo UGC autêntico superaram consistentemente o conteúdo profissional polido em 3 a 5x em taxa de conversão, CPM e ROAS. Polimento não é a alavanca. Volume de variação é.

Se você testa dois hooks por semana, vai ter uma resposta direcional em seis semanas. Testando oito, cai pra duas. A vantagem competitiva está na velocidade de iteração, não na qualidade de produção.

Onde o GPT Image 2 Entra Antes da Edição

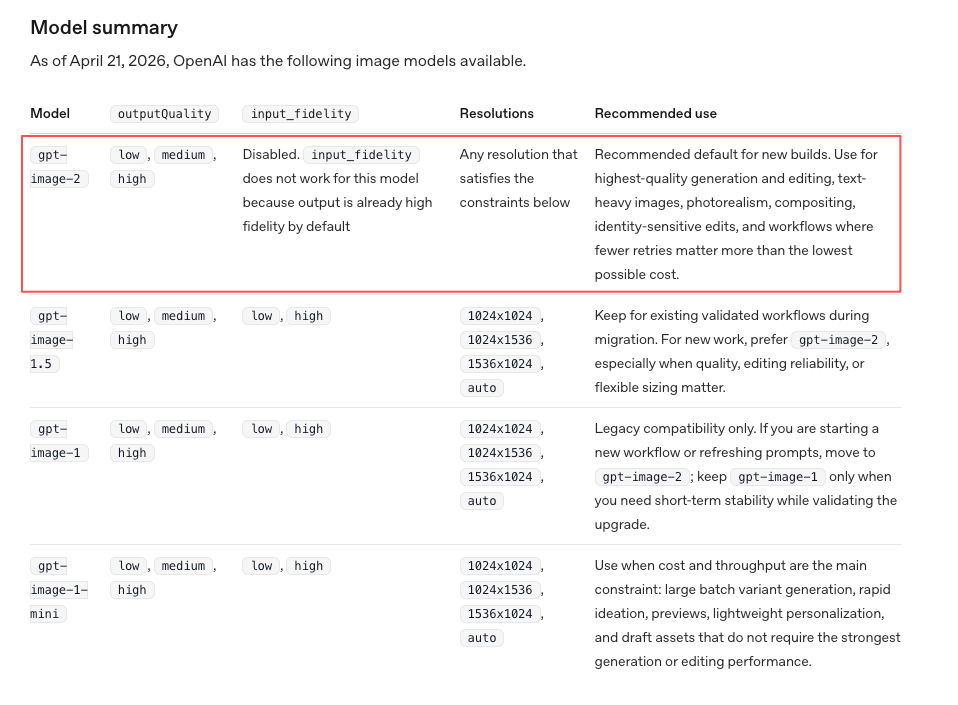

O GPT Image 2, lançado oficialmente como ChatGPT Images 2.0 em 21 de abril de 2026, não é uma ferramenta de vídeo. Isso é o mais importante a deixar claro antes de montar qualquer fluxo de trabalho em torno dele.

O que ele gera são conceitos de frame de abertura: imagens estáticas representando o primeiro momento visível de um vídeo. Um problema sobreposto a uma cena relacionável. Um produto revelado em ângulo específico. Um hook de curiosidade com copy limpo e legível. A imagem é o briefing pro seu edit — não o entregável final.

O guia oficial de prompting do modelo descreve uma construção voltada para "renderização confiável de texto com letras nítidas, layout consistente e alto contraste dentro das imagens" — exatamente o que frames de hook exigem. Modelos anteriores chegavam a 90–95% de precisão textual; o GPT Image 2 fica acima de 99% de precisão a nível de caractere em scripts latinos, CJK, hindi e bengali. Pra trabalho com hooks UGC — onde você precisa que callouts de preço, nomes de produto e copy on-screen apareçam legíveis — essa diferença separa um output utilizável de geração desperdiçada.

A documentação da API confirma suporte a resolução de até 2K com inputs de alta fidelidade — prático pra frames 9:16 na qualidade que o paid social exige.

Dito isso: toda imagem ainda precisa de energia de edição pra virar vídeo. O fluxo é gerar → filtrar → editar. Não gerar → publicar.

Os Melhores Tipos de Hook pra Gerar Primeiro

Hooks de Problema-Solução

É por aqui que começo em qualquer categoria de produto. Abre com um estado de dor reconhecível, implica a resolução. A lógica de prompt que funciona aqui é específica: cena + contexto emocional visível + texto sobreposto. "Uma pessoa olhando frustrada pro laptop, com o texto 'por que isso continua acontecendo antes do prazo'" gera um frame fundamentalmente diferente de "pessoa frustrada". Quanto mais preciso o beat emocional, mais utilizável o output.

Hooks de problema-solução testam bem porque combinam com como o UGC naturalmente performa nas plataformas — conteúdo que parece nativo e imediatamente relevante supera o conteúdo aspiracional. Um frame de problema-solução parece algo que uma pessoa real filmou. Esse é o padrão.

Hooks de Antes e Depois

Antes e depois funciona pra qualquer coisa com transformação física visível — produtos, espaços, interfaces, pele, fitness. O desafio: você está gerando dois conceitos, não um. O que funciona é fazer o prompt do estado "depois" primeiro — a versão resolvida e satisfatória — e usar essa imagem como âncora pro briefing. Você então direciona o B-roll pro estado "antes" na edição.

Não encontrei uma abordagem confiável de prompt único pra split-frame de antes e depois que segure. Duas gerações separadas mais uma edição combinam mais rápido e produzem resultados mais limpos.

Hooks de Reveal de Produto

Reveal lento, enquadramento dramático de produto, close extremo em textura — esses compram atenção retendo informação. O espectador não sabe o que está vendo, o que segura o watch time até o primeiro corte.

O GPT Image 2 segue instruções espaciais e de composição com precisão suficiente pra que especificidade no prompt valha diretamente. "Produto no terço inferior, fundo escuro matte, rim light única, crop extremo em textura" produz um output materialmente diferente de "foto de produto". O press release da OpenAI sobre o Images 2.0 descreve o modelo como construído para "preservar detalhes solicitados e renderizar elementos finos que costumam quebrar em modelos de imagem" — essa fidelidade de seguimento de instruções é o que faz prompts espaciais específicos funcionarem aqui.

Hooks de Curiosidade

Uma pergunta. Uma afirmação contraintuitiva. Um número específico demais pra ignorar.

Hooks de curiosidade são os mais difíceis de gerar com um modelo de imagem porque o copy carrega a maior parte do peso. O GPT Image 2 renderiza o texto com legibilidade — essa parte agora é confiável — mas a precisão do copy em si precisa vir do seu briefing, não do modelo. Meu processo: escrevo 8 a 10 opções de copy de hook antes de tocar na ferramenta, escolho as 3 mais fortes, depois gero frames visuais que apoiam cada uma. Não use o modelo pra idear copy. Use pra renderizar o copy que você já decidiu.

Fluxo de Trabalho: Do Briefing a Variantes de Vídeo Testáveis

Passo 1: Gere 5 a 10 Visuais de Abertura

15 a 20 prompts distribuídos pelos quatro tipos de hook. Outputs fracos — texto mal posicionado, enquadramento que não vai traduzir pra 9:16, fundos cheios demais que enterram o copy — são cortados imediatamente. O que passa vai pra um batch de revisão curto.

Uma coisa que não esperava: o GPT Image 2 mantém estilo visual consistente em um batch quando você trava os parâmetros de prompt. Estabeleça seu estilo de iluminação, temperatura de cor e densidade de cena no primeiro prompt e o restante do batch segue. Pra ad sets onde você quer variação de ângulo mas coerência estética, isso importa mais do que a maioria das reviews menciona.

Passo 2: Escolha 2 a 3 Vencedores

Três critérios:

Legibilidade em tamanho mobile. Tire screenshot da imagem a 390px de largura. Olhe por 1,5 segundo, depois desvie o olhar. Se você consegue lembrar o que o texto dizia, passou. Se precisou olhar de novo, não passou.

Potencial de movimento. Essa imagem tem um próximo frame lógico? Um close implica um zoom out. Um estado de problema implica um corte pra resolução. Se a imagem parece completa demais como estática, é mais difícil construir um vídeo em torno dela.

Enquadramento limpo. Texto sobreposto a fundos cheios, sujeitos centralizados sem espaço pra overlays de legenda, composições que não deixam espaço pro edit respirar — esses são corrigíveis, mas adicionam tempo. Corte-os nessa etapa.

Passo 3: Monte Edições Mínimas, Depois Teste

O frame de hook agora é um briefing. Você sabe o visual de abertura, o ângulo e o que o texto diz. O edit adiciona energia de movimento, sequencia a história e combina com o ritmo da plataforma. As orientações de rotação criativa da Meta são consistentes nesse ponto: rodar apenas uma versão acelera o fatigamento e limita o aprendizado. Cinco a oito variantes em dois a três ângulos é um batch inicial razoável. Com 48 a 72 horas de sinal, você vai saber qual vale produção completa.

O Que Torna um Hook Image Utilizável em Vídeo

Legibilidade no Primeiro Segundo

"Texto legível" e "texto legível enquanto alguém scrolla em velocidade normal num celular com metade da atenção em outro lugar" não são a mesma coisa. O teste mobile de 1,5 segundo acima é o que realmente filtra os outputs ruins. Os três modos de falha que mais vejo em hook frames do GPT Image 2: peso da fonte leve demais pro fundo, texto posicionado sobre região de fundo com muito detalhe, e linha de texto longa demais pro espaço disponível no frame. Esses geralmente exigem iteração no prompt pra corrigir — o modelo não resolve sempre na primeira geração.

Potencial de Movimento e Enquadramento Limpo

As imagens que convertem com mais facilidade em vídeo compartilham uma característica: espaço negativo. Espaço pro camera se mover, pra um overlay de texto sentar sem competir, pra o edit adicionar energia.

Evite imagens composicionalmente densas demais. Parecem impressionantes como estáticas e são genuinamente mais difíceis de trabalhar na edição. Quanto mais simples a estrutura visual, mais energia o edit pode contribuir — e em short-form, a energia vem do edit, não do frame estático.

Trade-offs Vale a Pena Falar Direto

Hooks Estáticos Ainda Precisam de Energia de Edição

O GPT Image 2 gera um conceito. A lacuna entre uma imagem conceito e um hook short-form funcionando é preenchida inteiramente pela edição — movimento, timing, áudio, posicionamento de legenda, ritmo. Times que tratam a imagem gerada como entregável vão se decepcionar. Times que tratam como briefing economizam 25 a 30 minutos por sessão. Em cinco sessões por semana, isso vira mais de duas horas de volta.

Se o seu gargalo é edição e não ideação, essa ferramenta não move esse gargalo.

Melhor Renderização de Texto Também É Uma Armadilha

A precisão textual acima de 99% pra scripts latinos e CJK é genuinamente útil. E também é uma tentação de enfiar mais copy no frame de hook. Não faça isso. Dados de testes criativos em campanhas UGC mostram consistentemente que os hooks mais eficazes criam uma única tensão ou pergunta, não uma transferência de informação. Quanto mais texto você coloca no frame de abertura, mais carga cognitiva você pede pro espectador aceitar antes de ele decidir assistir. Use a renderização melhorada pra fazer o texto que você já ia incluir parecer melhor — não como permissão pra incluir mais.

Perguntas Frequentes

O GPT Image 2 substitui um criador de UGC? Não. Um criador de UGC entrega um rosto real, reações reais e prova social. O GPT Image 2 gera conceitos visuais pra fase de ideação. O que ele substitui é o trabalho de concepção que antes exigia um designer ou uma longa sessão de briefing — não o elemento humano que faz o UGC converter.

Quantas variantes de hook os times devem testar? Cinco a oito em dois a três ângulos. O teto não é o tempo de geração — isso é rápido. É a capacidade de edição. Trabalhe de trás pra frente a partir de quantos edits você consegue realisticamente publicar e acompanhar por semana.

Produtos vs. apps — quais hooks funcionam melhor? Produtos com transformações visíveis (antes e depois, reveal, detalhe de textura) tendem a superar hooks de curiosidade — a prova visual é mais direta. Apps e serviços, onde a transformação é comportamental, vão melhor com hooks de problema-solução e curiosidade. Teste os dois antes de se comprometer.

Quando ir de teste de imagem pra vídeo completo? Quando você tiver um vencedor claro da fase estática. Escolha 2 a 3 conceitos fortes, monte edições mínimas, rode 48 a 72 horas de sinal, depois invista tempo de produção no vencedor.

Conclusão

O GPT Image 2 vale a pena adicionar a um fluxo de trabalho de ads UGC especificamente pelo que ele realmente faz: gerar conceitos de frame de abertura mais rápido e em maior volume do que qualquer opção anterior. Não como ferramenta de vídeo, não como substituto de criador, não como solução pra um gargalo de edição.

Taxa de retrabalho caiu de 68% pra 31% nos meus testes. Volume de conceitos foi de 2–3 pra 7–10 por briefing. A fase de ideação foi de 45–60 minutos pra 20. Se você produz mais de cinco ads short-form por semana, isso vira economia real de tempo dentro do primeiro mês.

Se você produz um ou dois por semana, o overhead do fluxo provavelmente não justifica adicionar mais uma ferramenta ainda.

Leituras Recomendadas

GPT Image 2 para thumbnails do YouTube e TikTok em 2026

Avaliações de Ferramentas de Vídeo UGC Colaborativo em 2026

GPT Image 2: O Que os Criadores Precisam Saber Antes do Lançamento